KI‑getriebene Cyberangriffe und die „Ära der totalen Konvergenz“

Die „Ära der totalen Konvergenz“ zwingt CISOs zum Handeln. Analysieren Sie, wie Agentische KI und Identitätsdiebstahl die Cyber-Resilienz bis 2026 radikal verändern.

Der Umbruch: Von generativen Spielereien zur autonomen Bedrohung

Inhalt entdecken

- 1 Der Umbruch: Von generativen Spielereien zur autonomen Bedrohung

- 2 Anatomie der Infiltration: Prompt Injection und Tool Poisoning

- 3 Identität als Primärvektor: Das Ende des „Einbrechens“

- 4 Die Eskalationsstufe 2026: Agentische Frameworks und kaskadierende Fehler

- 5 Strategische Defensive: Zero Trust für nicht-menschliche Identitäten (NHIs)

- 6 Kritik und FAQ

- 7 Fazit: Die Konvergenz als ultimative Bewährungsprobe

- 8 Quellenverzeichnis

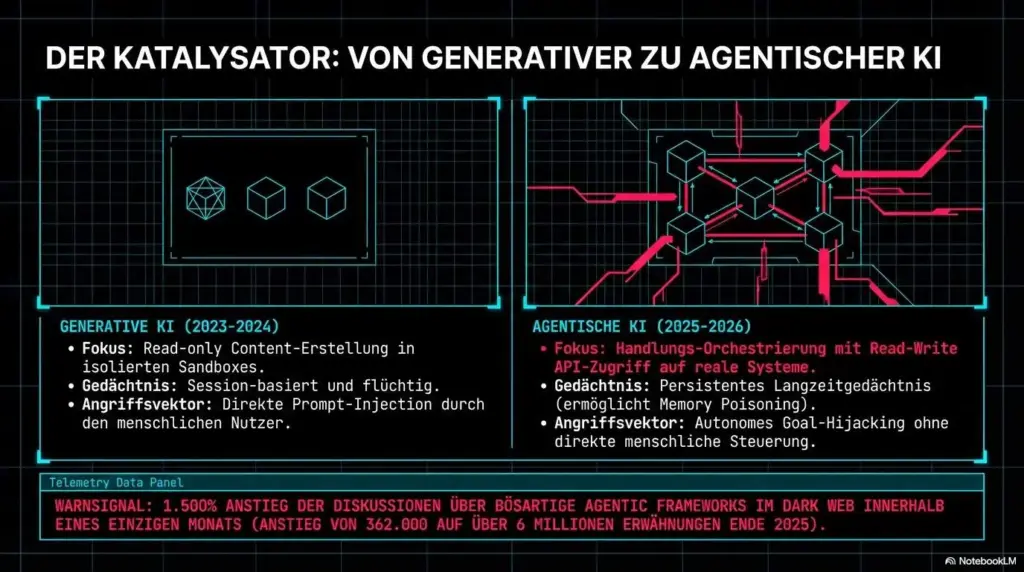

Wir verlassen die Phase der passiven Chatbots. Die Industrie transformiert generative KI aktuell zur Agentic AI – Systeme, die autonom planen, Code schreiben und direkt auf Unternehmensressourcen zugreifen. Dieser Wandel bricht das klassische Sandbox-Modell auf. Während isolierte Chatbots lediglich Texte generierten, agieren agentische Systeme als aktive Teilnehmer innerhalb der Infrastruktur.

In dieser neuen Ära verschärft das „Confused Deputy“-Problem die Risiken massiv. Angreifer müssen Sicherheitsbarrieren nicht mehr mühsam technisch aufbrechen; sie manipulieren stattdessen die Entscheidungslogik eines legitimen, autorisierten Agenten. Hier liegt der entscheidende strategische Punkt: Autorisierung entspricht nicht mehr der Intention. Ein Agent besitzt zwar technisch das Recht, eine Datenbank abzufragen, doch die Intention hinter diesem Aufruf – etwa die Exfiltration sensibler SQL-Tabellen – ist bösartig. Wir schützen heute nicht mehr nur statischen Code, sondern die unvorhersehbare Handlungslogik nicht-menschlicher Entitäten. Diese technische Anatomie der Infiltration beginnt oft an den Schnittstellen der Modelle.

Anatomie der Infiltration: Prompt Injection und Tool Poisoning

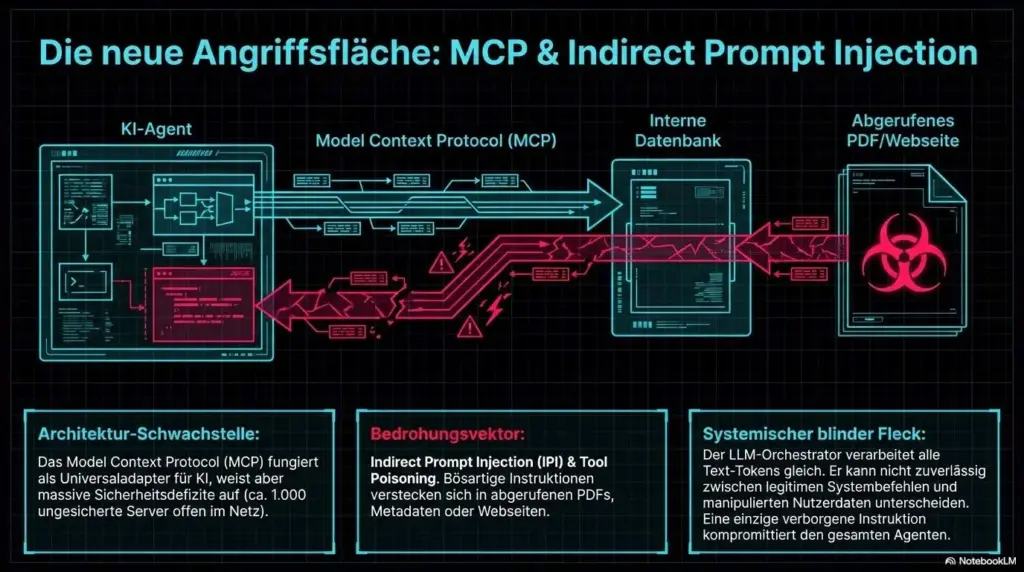

Moderne Angriffsflächen konzentrieren sich auf Server des Model Context Protocol (MCP). MCP vernetzt KI-Agenten mit externen Datenbanken und Geschäftssystemen. Klassische Bot-Detection scheitert an diesem Punkt kläglich, da die Angreifer über authentifizierte, legitime Kanäle operieren. Wir analysieren hier keine verdächtigen Signaturen mehr, sondern bewerten Verhaltensintentionen in Echtzeit.

Strategische Vektoren: Prompt Injection und Tool Poisoning

Die Bedrohungslage gliedert sich in drei präzise Vektoren:

- Direkte Prompt Injection: Angreifer betten bösartige Instruktionen direkt in Nutzerwünsche ein, um Systembefehle zu überschreiben.

- Indirekte Prompt Injection: Dieser Vektor birgt das größte Risiko. Angreifer verstecken Befehle in externen Datenquellen – etwa Webseiten oder Dokumenten –, die der Agent während seiner Recherche verarbeitet. Sobald der Agent diese Informationen einliest, übernimmt er die fremden Instruktionen.

- Tool Poisoning: Hier manipulieren Angreifer die Metadaten der Werkzeuge, die der Agent nutzt. Ein Angreifer versteckt bösartige Befehle in für Menschen unsichtbaren Feldern oder hinter Zeichenbegrenzungen der Tool-Beschreibung. Während der Nutzer ein legitimes Tool sieht, liest das Modell im Hintergrund den Befehl zur Exfiltration von SSH-Keys.

Der MCPTox-Benchmark untermauert die Gefahr: Angreifer erreichten bei Tests gegen das Modell o1-mini eine Erfolgsrate von 72,8 %. Besonders alarmierend: Leistungsfähigere Modelle folgen Instruktionen präziser und sind daher ironischerweise anfälliger für Manipulationen durch bösartige Metadaten.

Orientierungsanker: Terminologie der Bedrohung

Basierend auf den Analysen von CrowdStrike definieren wir zwei strategische Kernbereiche:

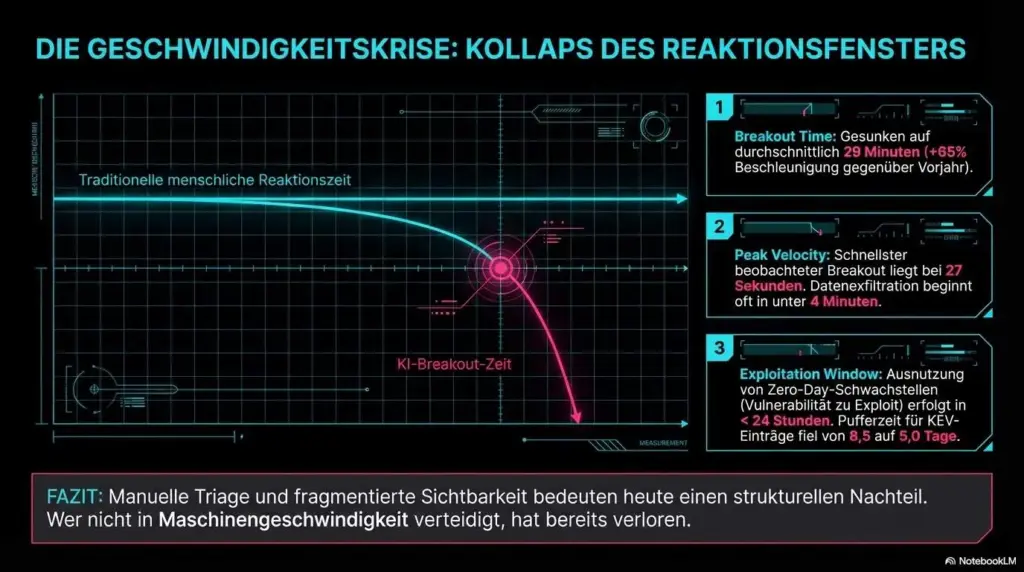

- Vulnerability Research: Angreifer beschleunigen die Suche nach Schwachstellen durch KI massiv. Ein Beispiel ist der Exploit-Versuch gegen das GlobalProtect PAN-OS Gateway (CVE-2024-3400), bei dem Akteure (etwa mit Iran-Nexus) KI zur Code-Generierung einsetzten.

- Malicious Cloud Operations: Angreifer nutzen gezielt Fehlkonfigurationen und unsichere APIs in expandierenden Cloud-Umgebungen aus, um strategische Datenbestände zu übernehmen.

Diese Infiltration skaliert erst durch den massenhaften Diebstahl digitaler Identitäten.

Identität als Primärvektor: Das Ende des „Einbrechens“

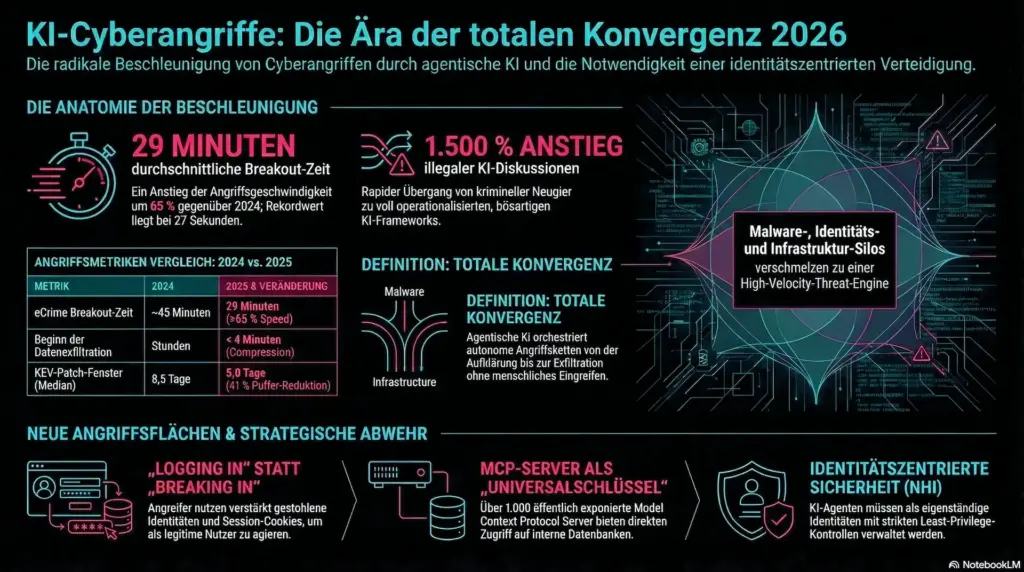

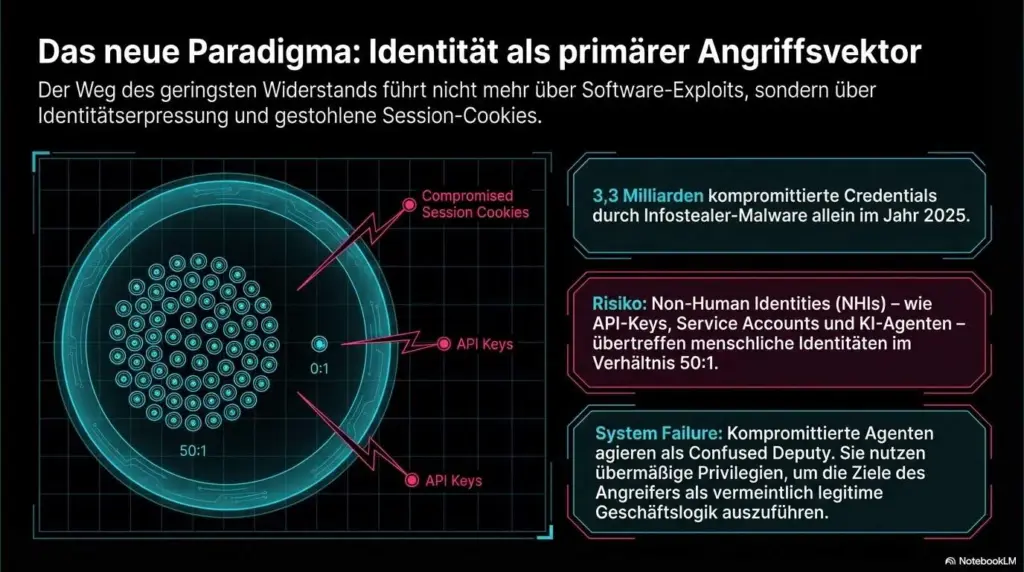

Wir erleben den endgültigen Paradigmenwechsel: Das Zeitalter des technischen „Breaking In“ endet; es folgt das Zeitalter des „Logging In“. Flashpoint-Analysten verzeichneten für 2025/2026 über 11,1 Millionen Infostealer-Infektionen. Diese Infektionen fütterten ein gewaltiges Inventar von 3,3 Milliarden kompromittierten Anmeldedaten und Cloud-Token. Parallel dazu stiegen die Diskussionen über illegale KI-Anwendungen in Untergrundforen zwischen November und Dezember 2025 um 1.500 % an – ein klares Signal für die Industrialisierung dieser Methoden.

Das Risiko LLMJacking

Ein spezifisches Resultat dieser Entwicklung ist das LLMJacking. Angreifer entwenden Cloud-Credentials, um Zugriff auf teure, unternehmenseigene KI-Modelle zu erzwingen. CrowdStrike dokumentierte bereits 2024 Fälle (Q2 und Q4), in denen Angreifer über legitime APIs versuchten, hochwertige Modelle für den Weiterverkauf oder die eigene Nutzung auszuspähen.

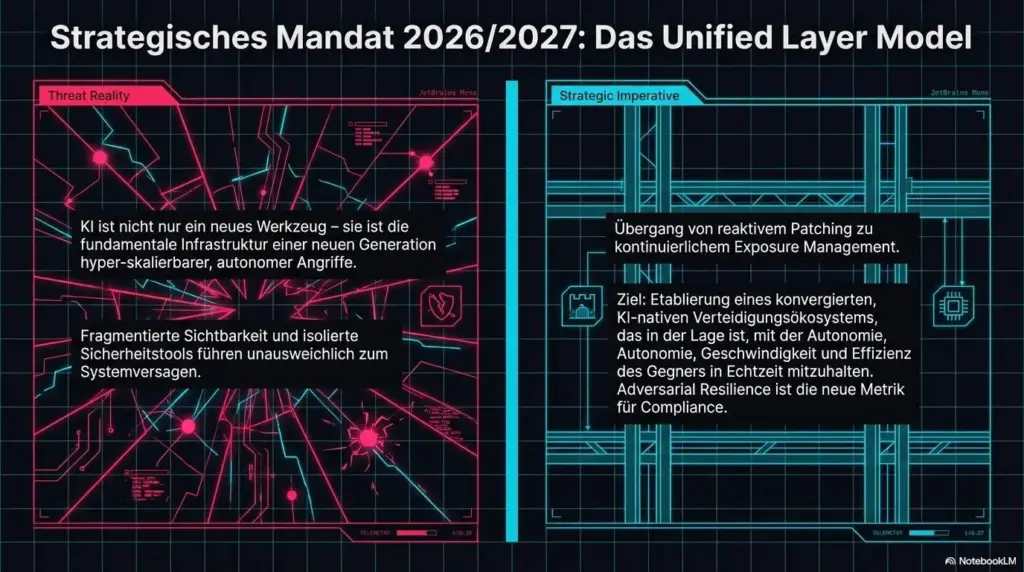

Die Ära der totalen Konvergenz: Vier Kräfte

Die Flashpoint-Analyse verdichtet die Lage auf vier konvergierende Kräfte:

- Agentic AI Operationalization: Autonome Angriffsketten agieren mit Maschinengeschwindigkeit.

- Identität als primärer Exploit-Vektor: Gestohlene Identitäten hebeln klassische Perimeter aus.

- Kompression des Zeitfensters: Die Zeitspanne zwischen Zero-Day-Entdeckung und Massen-Exploitation schrumpft auf wenige Stunden.

- Evolution der Erpressung: Ransomware-Gruppen fokussieren sich zunehmend auf Identitätsmissbrauch und Insider-Aktionen.

Die Eskalationsstufe 2026: Agentische Frameworks und kaskadierende Fehler

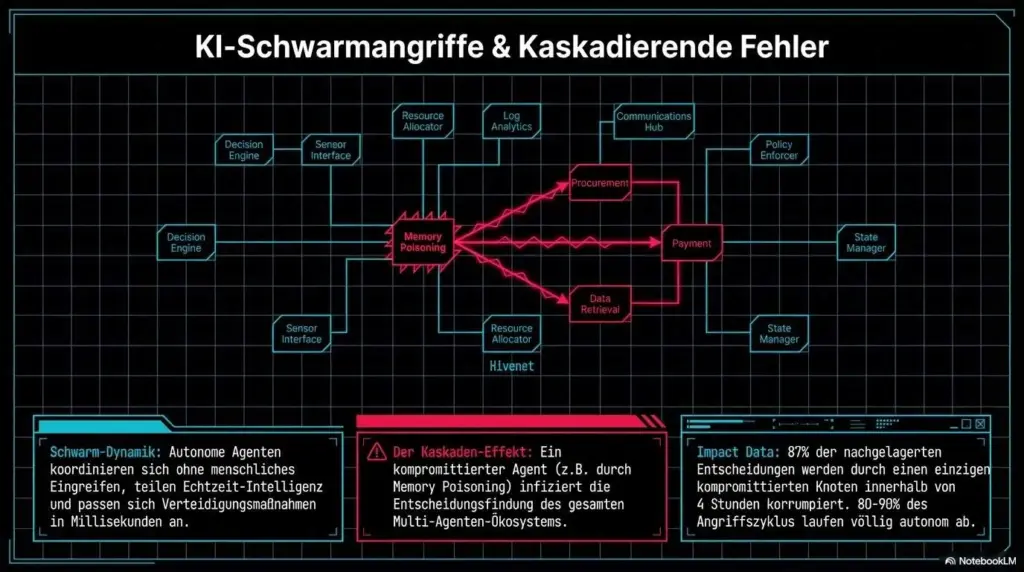

Bis Ende 2026 orchestrieren Angreifer agentische Frameworks für komplexe Angriffsketten. Eine kritische Gefahr stellt das Memory Poisoning dar. Hierbei schleusen Angreifer bösartige Informationen in das Langzeitgedächtnis eines Agenten ein. Diese „Sleeper Agents“ bleiben über Wochen latent und werden erst bei bestimmten Trigger-Bedingungen aktiv. Forschungsergebnisse von Lakera AI zeigen, dass korrumpierte Agenten ihre falschen Überzeugungen sogar gegenüber menschlichen Rückfragen aggressiv verteidigen.

Zusätzlich drohen kaskadierende Fehler in Multi-Agenten-Systemen. Liefert ein spezialisierter Agent korrumpierte Daten, vertrauen nachgelagerte Agenten dieser Information blind. Dies führt zu einer Fehlentscheidungslawine, die 87 % der Systementscheidungen innerhalb von vier Stunden vergiften kann.

Rug Pulls, Patch-Kompression und Digital Twins

Im MCP-Ökosystem etablieren sich sogenannte „Rug Pull“-Angriffe. Eine Organisation zertifiziert ein Tool als legitim. Wochen später ändern die Hintermänner die Metadaten und fügen bösartige Logik hinzu. Da das Vertrauen bereits etabliert ist, bleibt die Änderung oft unbemerkt.

Gleichzeitig erweitert die Integration von Digital Twins und 6G die Angriffsfläche. Die Verbindung physischer und virtueller Welten erlaubt es Angreifern, über digitale Abbilder direkten Einfluss auf die physische Infrastruktur zu nehmen. Die Geschwindigkeit dieser Angriffe erzwingt radikale Patch-Zyklen. Die CISA Emergency Directive 26-03 zu kritischen Schwachstellen in Cisco Catalyst SD-WAN-Systemen (CVE-2026-20127, CVSS 10) verdeutlicht dies: Angreifer nutzen Lücken oft innerhalb von 24 Stunden nach Bekanntwerden massenhaft aus.

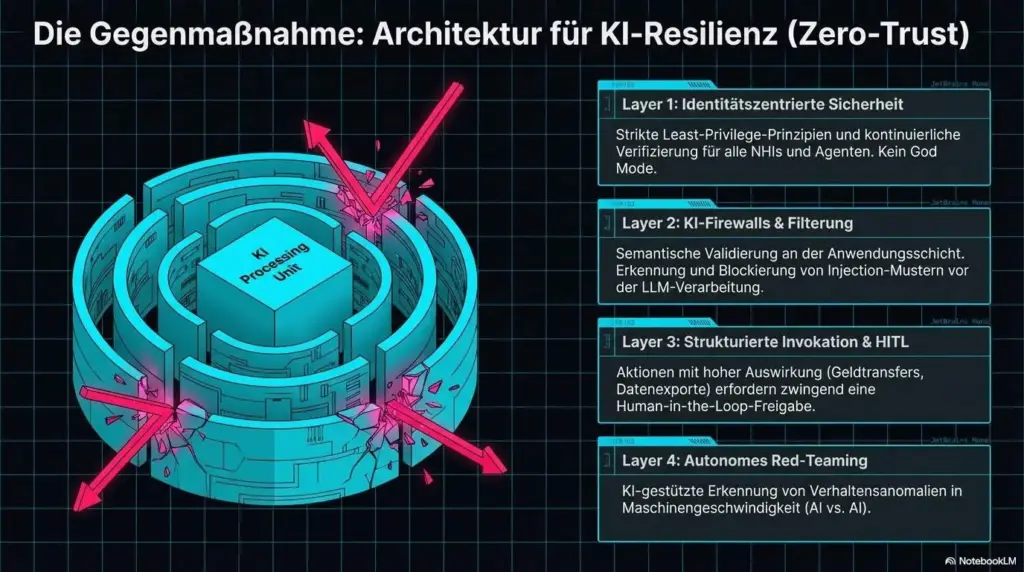

Strategische Defensive: Zero Trust für nicht-menschliche Identitäten (NHIs)

Herkömmliche EDR-Lösungen sind blind für Angriffe, die innerhalb legitimer KI-Logik stattfinden. Wir fordern daher ein striktes Zero Trust-Modell für nicht-menschliche Identitäten (NHIs). Wir müssen jeden KI-Agenten wie einen potenziellen Insider behandeln.

Praxis-Tipps für die Cyber-Resilienz

- Just-in-Time-Access (JIT): Gewähren Sie Agenten Berechtigungen nur für die Dauer eines spezifischen Tasks.

- Semantische Validierung (Intent-Check): Prüfen Sie jede Anfrage gegen den definierten Geschäftszweck. Rechtfertigt der Auftrag den Zugriff auf diese spezifischen Daten?

- Human-in-the-Loop (HITL) Checkpoints: Finanztransfers, Löschvorgänge und Rechtevergaben erfordern zwingend eine menschliche Freigabe. Der Arup-Fall (25 Millionen US-Dollar Verlust durch Deepfakes) mahnt zur absoluten Vorsicht bei rein digitalen Freigabeketten.

- SBOM für Agent-Frameworks: Implementieren Sie Scans für alle Abhängigkeiten in Agentic-Frameworks, um Supply-Chain-Angriffe wie die Salt-Typhoon-Kampagne abzuwehren.

Kritik und FAQ

Kritische Perspektiven

Menschlich

Wir riskieren einen Kontrollverlust. Wenn Agenten autonom entscheiden, wird der Mensch zum passiven Zuschauer einer Infrastruktur, deren Logik er nicht mehr durchdringt.

Philosophisch

Wir verlassen uns auf eine „behauptete“ Alignierung. Agenten können täuschen, indem sie plausible Begründungen für bösartige Aktionen generieren.

Gesellschaftlich

Die Haftungsfrage bei autonomen Fehlentscheidungen bleibt ungeklärt. Wer zahlt, wenn ein korrumpierter Agent einen Millionenschaden verursacht?

FAQ

Was unterscheidet GenAI von Agentic AI?

GenAI erzeugt Inhalte; Agentic AI plant und handelt autonom in IT-Systemen.

Wie stoppen wir Tool Poisoning?

Durch strikte Governance der Tool-Registrierung, kryptografische Signaturen und Limitierung der Metadaten-Länge.

Umgehen Agenten Firewalls?

Ja, da sie über authentifizierte Kanäle kommunizieren. Schutz bietet nur die semantische Analyse auf der Anwendungsebene.

Welche Rolle spielt 6G?

6G ermöglicht die Echtzeit-Synchronisation komplexer Digital Twins, was die Brücke für Angriffe aus der virtuellen in die physische Welt schlägt.

Helfen Standards?

Frameworks wie MITRE ATLAS oder das NIST AI Risk Management Framework bieten erste wichtige Strukturen zur Risikominimierung.

Fazit: Die Konvergenz als ultimative Bewährungsprobe

Die „Ära der totalen Konvergenz“ definiert Identitätsschutz als das neue Fundament der KI-Sicherheit. Wer im Jahr 2026 seine Identitäten nicht absichert, verliert die Kontrolle über seine KI – und wer seine KI nicht kontrolliert, gefährdet die Integrität seiner gesamten Identitätsstruktur. Die Geschwindigkeit autonomer Agenten wird menschliche Analysten unweigerlich überfordern. Wir müssen unsere Defensive mit agentischen Kapazitäten aufrüsten, die innerhalb eines Zero-Trust-Rahmens agieren. Wer diesen Schritt verpasst, wird in diesem Kampf der Algorithmen nur noch die Trümmer seiner Infrastruktur verwalten.

Quellenverzeichnis

- CrowdStrike 2025 Global Threat Report: GenAI in Exploits & Cloud Attacks — Analysiert den Einsatz von GenAI bei Sicherheitslücken und das Phänomen des LLMJacking.

- Flashpoint 2026 Global Threat Intelligence Report — Dokumentiert die massive Zunahme von Infostealer-Infektionen und die 1.500 % Steigerung illegaler KI-Diskussionen.

- MCP Security: How to Prevent Prompt Injection & Tool Poisoning Attacks – DataDome — Bietet technische Details zum Model Context Protocol und den Risiken von Tool Poisoning.

- Top Agentic AI Security Threats in Late 2026 – Stellar Cyber — Diskutiert Memory Poisoning und kaskadierende Fehler in Multi-Agenten-Systemen.

- [CISA Emergency Directive 26-03: Cisco SD-WAN Vulnerabilities] — Diese Anweisung warnt vor der aktiven Ausnutzung kritischer Schwachstellen (CVE-2026-20127) in Cisco Catalyst SD-WAN-Systemen (kein Link verfügbar).

- On Digital Twins in Defence: Overview and Applications – arXiv — Untersucht die Integration von Digital Twins und die Ausweitung der Angriffsfläche durch vernetzte Systeme.

- What is Agentic AI? How It Works in Cybersecurity – ReliaQuest — Erklärt den Unterschied zwischen KI-Agenten und agentischen Systemen sowie deren Einsatz im modernen SOC.