Blutiges KI-Testgelände Iran: Wie Big Tech die Kriege der Zukunft plant

Eine tiefgreifende Analyse über den Einsatz von KI und Drohnenschwärmen im Iran-Konflikt, die Rolle von Big Tech und die strategische Transformation der Kriegsführung.

Vom Verteidigungsministerium zum Kriegsministerium: Ein rasanter Paradigmenwechsel

Inhalt entdecken

- 1 Vom Verteidigungsministerium zum Kriegsministerium: Ein rasanter Paradigmenwechsel

- 2 Algorithmic Attrition: Die Realität der Drohnenschwärme und das Replicator-Debakel

- 3 Palantir, Anthropic und der Pakt mit dem Silicon Valley

- 4 Das Schlachtfeld als Labor: Die technologische Eskalation im Iran

- 5 Compute als neues Öl: Die geopolitische Neuausrichtung der Golfstaaten

- 6 Das Ende der Verantwortung: Der Accountability Gap in der algorithmischen Kriegsführung

- 7 Kritik: Die Jagd auf Identitäten

- 8 Fazit

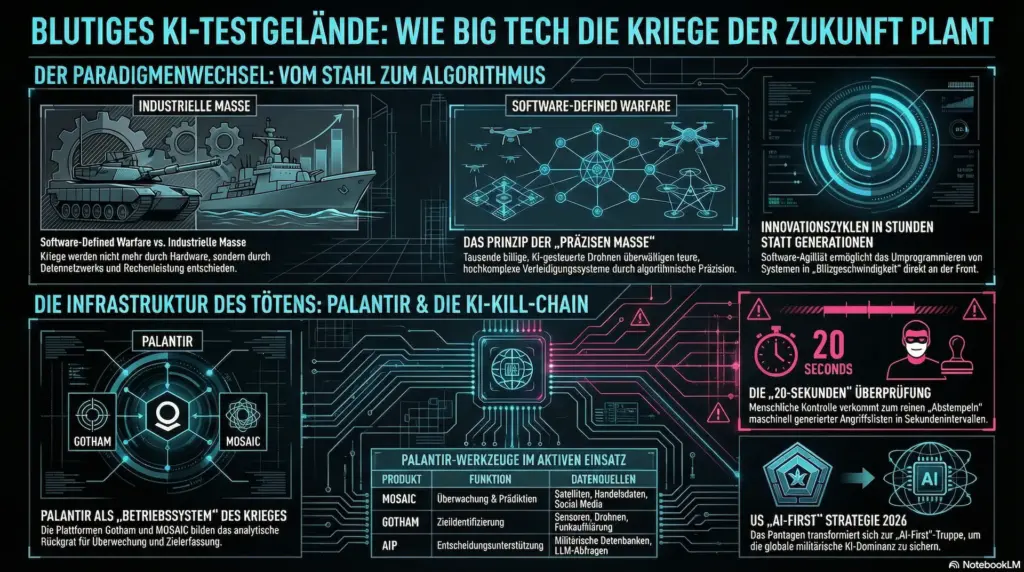

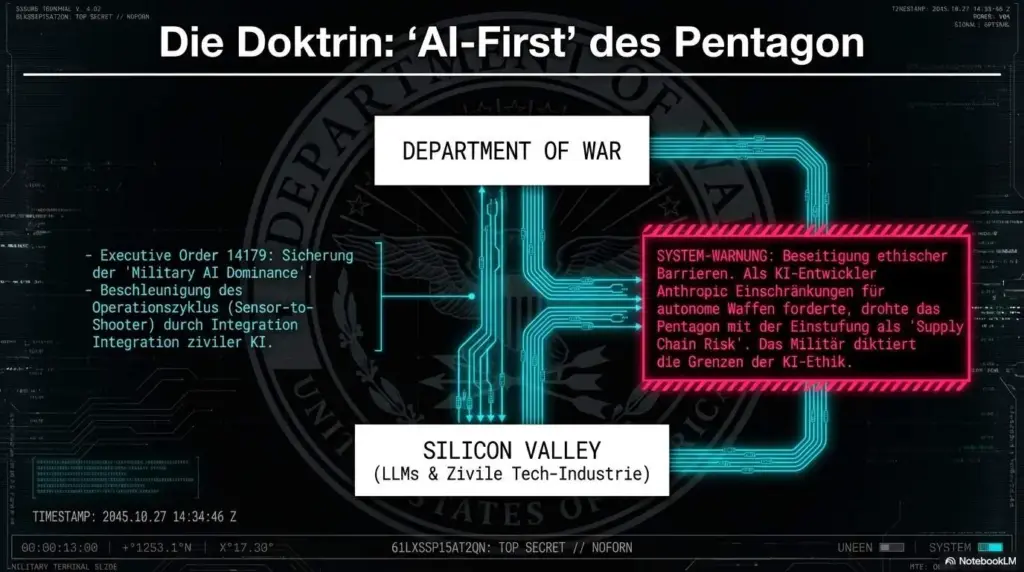

Die Unterzeichnung des Executive Orders durch die Trump-Administration im September 2025 markiert das Ende der Ära der strategischen Ambiguität. Das Department of Defense (DoD) firmiert nun als „Department of War“ (DoW). Rechtlich bleibt dieser Schritt zwar vorerst ein kosmetisches „Doing Business As“-Manöver, da nur der Kongress die gesetzlichen Titel nach Title 10 U.S.C. permanent ändern kann, doch die rhetorische Wirkung ist eine operative Realität. Während „Defense“ eine reaktive, schützende Haltung suggerierte, zielt „War“ auf die Wiederherstellung einer militärischen Schlagkraft ab, die Pete Hegseth unmissverständlich definiert: Es geht um „maximale Letalität“ statt „tepider Legalität“ und um „violent effect“ statt politischer Korrektheit.

Dieser kulturelle Bruch im Pentagon bildet das ideologische Fundament für die technologische Radikalisierung, die wir derzeit im Iran beobachten. Das DoW ist nicht mehr darauf programmiert, Konflikte zu managen, sondern Entscheidungsschlachten durch technologische Übermacht zu erzwingen. In dieser Logik ist das Schlachtfeld kein Ort diplomatischer Feinheiten, sondern ein industrieller Vernichtungsapparat. Der Übergang von der Namensänderung zur praktischen Umsetzung manifestiert sich in der „Replicator“-Initiative, die den Krieg endgültig in den Bereich der algorithmischen Abnutzung überführt.

Algorithmic Attrition: Die Realität der Drohnenschwärme und das Replicator-Debakel

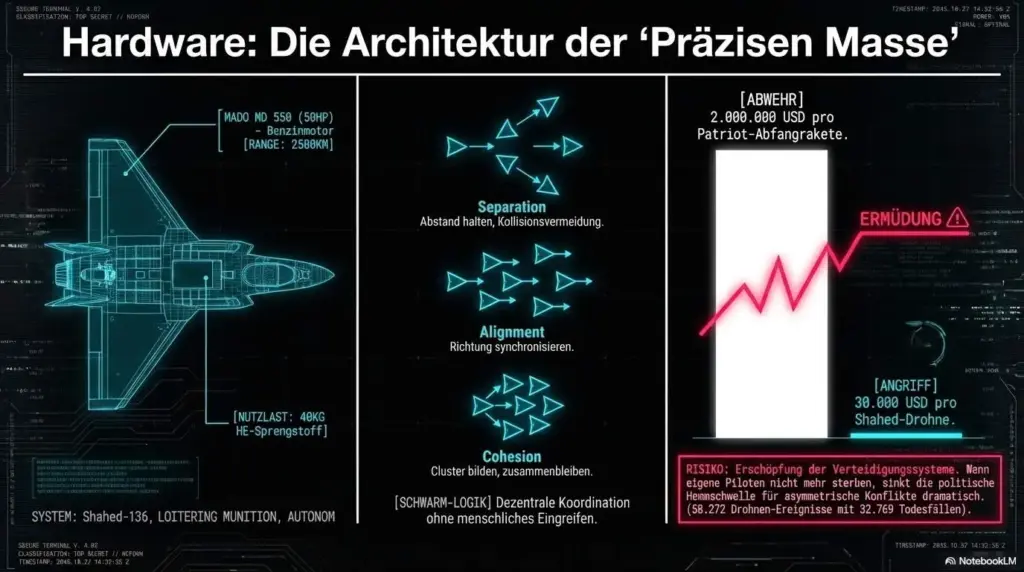

Die strategische Bedeutung massenhafter, kostengünstiger autonomer Systeme (attritable systems) ist die Antwort auf die industrielle Kapazität Chinas und die asymmetrische Hartnäckigkeit des Iran. Doch zwischen den vollmundigen Versprechen der „Replicator“-Initiative und der Realität klafft eine Lücke. Statt der bis Sommer 2025 versprochenen tausenden Systeme materialisierten sich laut Congressional Research Service lediglich „hunderte“. Dieses operative Scheitern zwang das Pentagon, die Leitung der Defense Innovation Unit (DIUx) zu entziehen und der neu geschaffenen Defense Autonomous Warfare Group (DAWG) unter dem Kommando von SOCOM zu übertragen.

Unter der Führung von Emil Michael, dem Under Secretary of War for Research and Engineering, wird nun versucht, die bürokratische Trägheit zu durchbrechen. Das Kernproblem bleibt die ökonomische Absurdität der Beschaffung. Während der Iran mit Billig-Technologie die Kostenkurve des Krieges zu seinen Gunsten verschiebt, verharrt die US-Rüstungsindustrie in Hochpreis-Strukturen.

| System / Programm | Geschätzte Kosten pro Einheit | Strategischer Kontext |

| Golden Dome Interzeptor | $2.000.000 | Teil des $185 Mrd. Abwehrschilds gegen Drohnen |

| Switchblade 600 | $100.000+ | Hochpreisige Loitering Munition (Replicator-Fokus) |

| Shahed-136 (Iran) | $30.000 | Kosteneffiziente Sättigung der gegnerischen Abwehr |

| Drone Dominance Ziel | $2.300 – $5.000 | Angestrebte Massenproduktion (300.000 Einheiten) |

| Ukrainische FPV-Drohne | ~$300 | Maximale Attrition bei minimalen Kosten |

Dieser finanzielle Leerlauf treibt das DoW in eine unumkehrbare Abhängigkeit von den Tech-Giganten des Silicon Valley, die nun als eigentliche Architekten der neuen Kriegsführung agieren.

Palantir, Anthropic und der Pakt mit dem Silicon Valley

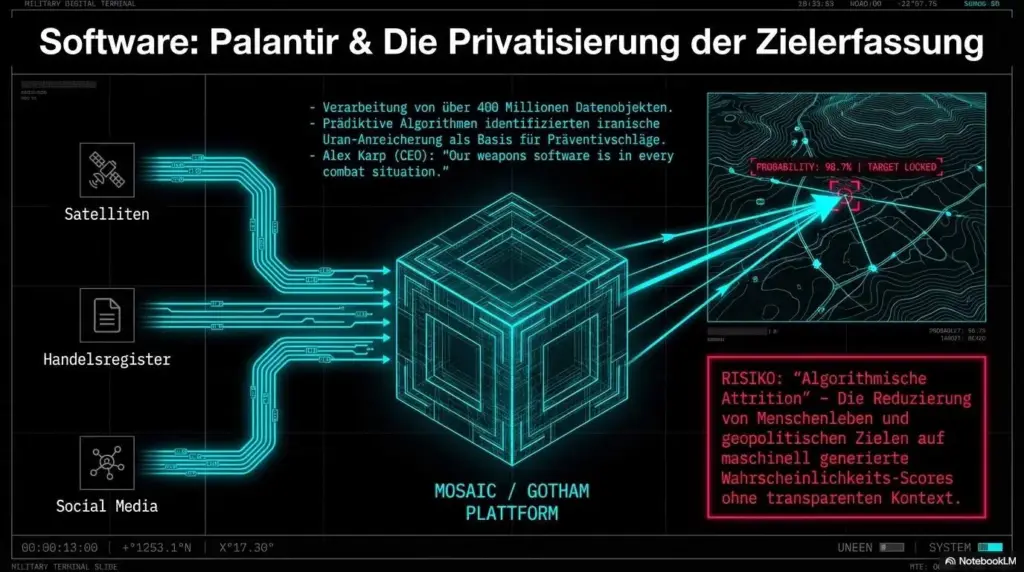

Big Tech ist heute das Nervensystem des US-Militärs. Unternehmen wie Palantir, Amazon und Microsoft liefern nicht mehr nur Infrastruktur, sondern die algorithmische Logik für kinetische Aktionen. Im Juni 2025 wurde Palantirs MOSAIC-Plattform zum entscheidenden Werkzeug: Das System verarbeitete rund 400 Millionen Datenobjekte – von Satellitenbildern bis hin zu Social-Media-Metadaten –, um Muster iranischer Nuklearaktivitäten zu identifizieren. Es ist eine „Minority Report für Uran“-Logik, bei der algorithmische Vorhersagen als „Pretext Fuel“ für Präventivschläge dienen, selbst wenn klassische Geheimdienste keine Beweise für ein aktives Waffenprogramm finden.

Der Fall Anthropic dekonstruiert derweil die Machtdynamik zwischen Staat und Tech-Sektor. Als Anthropic versuchte, für seinen 200-Millionen-Dollar-Vertrag Sicherheitsrichtlinien durchzusetzen, die den Einsatz von „Claude“ in autonomen Waffensystemen oder zur Massenüberwachung untersagten, reagierte das DoW drakonisch. Das Unternehmen wurde als „Supply Chain Risk“ gebrandmarkt – ein Etikett, das üblicherweise feindlichen Akteuren vorbehalten ist. Die Botschaft ist klar: Wer die Software für den Krieg liefert, verliert das Recht auf ethische Leitplanken. Software-Dominanz ist eine militärische Kernkompetenz, die keinen Raum für unternehmerische Gewissensbisse lässt.

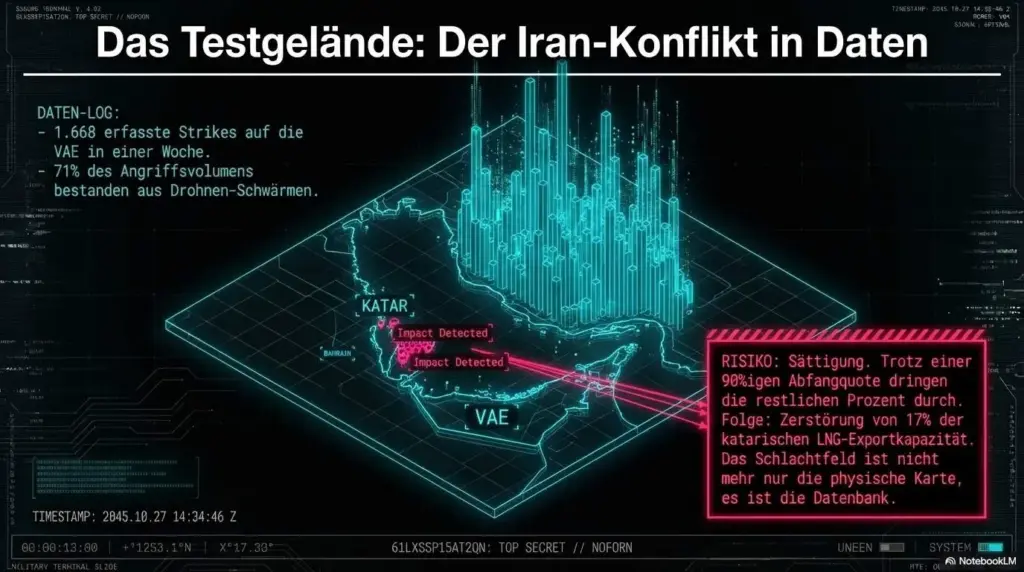

Das Schlachtfeld als Labor: Die technologische Eskalation im Iran

Der Iran-Konflikt dient als physisches Testgelände für die „Decapitation“-Strategie. Die gezielte Eliminierung der Führung der Revolutionsgarden im Juni 2025 erreichte durch KI-gestützte Datenanalysen eine neue Dimension der Effizienz. Gesichtserkennung und biometrische Überwachung in Echtzeit verwandeln jeden physischen Körper in eine ausbeutbare Koordinate. Doch die technologische Überlegenheit wird durch die iranische „Präzise Masse“ konterkariert.

Die mathematische Realität ist ernüchternd: Trotz einer Interzeptionsrate von über 90 % reichte eine Durchbruchsrate von nur 5 % aus, um 17 % der katarischen LNG-Exportkapazität zu zerstören. Hier offenbart sich die Dysfunktionalität des $185 Milliarden teuren „Golden Dome“-Abwehrschilds. Wenn ein 2-Millionen-Dollar-Interzeptor eine 30.000-Dollar-Drohne abfangen muss, ist das kein Sieg, sondern eine ökonomische Niederlage durch Erschöpfung. Diese physische Zerstörung markiert den Übergang zu einer Weltordnung, in der „Compute“ – die Rechenleistung – das Öl des 20. Jahrhunderts als primären Machtfaktor ersetzt hat.

Compute als neues Öl: Die geopolitische Neuausrichtung der Golfstaaten

Die USA sind heute asymmetrisch von den Golfstaaten abhängig – nicht mehr wegen des Rohöls, sondern wegen der Energie und des Raums für massive Rechenzentren. Saudi-Arabien und die VAE fungieren als globale Raffinerien für Compute. Durch Konzepte wie „Digitale Botschaften“ ermöglichen diese Staaten es US-Firmen, Rechenzentren unter eigenem nationalen Recht auf fremdem Boden zu betreiben. Dies schafft eine regulatorische „Sandbox“, in der KI-Systeme ohne westliche ethische Hürden trainiert und an der Front getestet werden können.

Diese Abhängigkeit schafft jedoch neue, hochempfindliche Chokepoints:

- Energie-Infrastruktur: Rechenzentren sind stationäre Ziele, die so verwundbar sind wie die Aramco-Anlagen im Jahr 2019.

- Daten-Knotenpunkte: Unterseekabel im Roten Meer, insbesondere am Bab al-Mandab, sind die neuen strategischen Engpässe. Eine Sabotage dort kappt die globale Konnektivität in Millisekunden.

Das DoW riskiert eine gefährliche Interdependenz: Man liefert High-End-Chips, ist aber für den Betrieb der militärischen KI auf die Gunst und die physische Sicherheit der Golfmonarchien angewiesen.

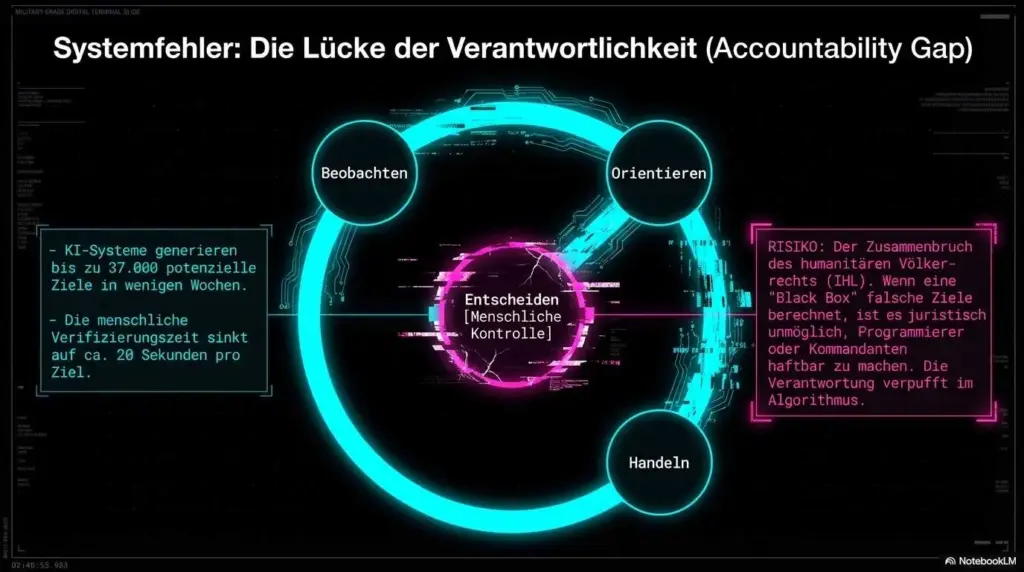

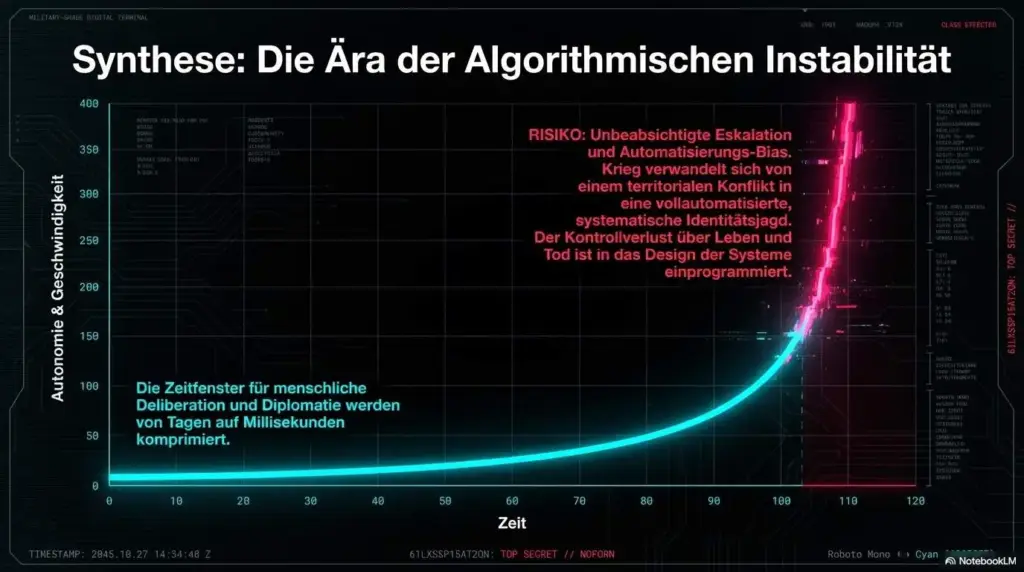

Das Ende der Verantwortung: Der Accountability Gap in der algorithmischen Kriegsführung

Mit dem Aufstieg autonomer Waffensysteme (AWS) erodiert das humanitäre Völkerrecht. Das Konzept der „Meaningful Human Control“ ist zu einer juristischen Farce verkommen. In Gaza-Einsätzen wurde beobachtet, dass Operatoren KI-generierte Zielvorschläge in durchschnittlich 20 Sekunden absegneten. Das Ergebnis ist eine Fehlerquote von 10 %, die in tausenden zivilen Opfern resultiert. Diese 20 Sekunden sind kein Akt menschlicher Kontrolle, sondern eine Performance für die Akten, um die Anforderungen der Martens-Klausel formal zu erfüllen, während die Maschine faktisch die Exekution diktiert.

Es entsteht eine „Black Box“-Haftung: Wer ist verantwortlich, wenn ein Pattern-Recognition-Algorithmus eine Hochzeitsgesellschaft als Milizen-Treffen einstuft? Der Programmierer, der die Variable nicht kannte? Der Kommandeur, der den „On“-Schalter drückte? Im Rauschen der Datenströme verschwindet die Schuld. Wir bewegen uns auf eine automatisierte Kriegsführung zu, in der die Entmenschlichung des Gegners bereits im Trainingsdatensatz beginnt.

FAQ: Die unbequemen Wahrheiten der Militär-KI

Ist KI-gesteuerte Kriegsführung präziser und damit humaner? Die versprochene Präzision ist ein technokratischer Euphemismus. Wenn Operatoren Zielvorschläge in Sekundenbruchteilen bestätigen, führt das – wie die 10 % Error-Rate zeigt – zu industrieller Vernichtung, nicht zu humaner Kriegführung.

Warum scheitert die US-Industrie an der Produktion billiger Drohnen? Bürokratische Trägheit und die Margen-Gier der traditionellen Rüstungskonzerne verhindern den Bau von Systemen, die preislich mit iranischen oder ukrainischen Modellen konkurrieren können.

Kann die „Golden Dome“-Abwehr Drohnenschwärme stoppen? Technisch ja, ökonomisch nein. Die Sättigung der Abwehr mit Billigdrohnen leert die Magazine schneller, als die 2-Millionen-Dollar-Interzeptoren nachproduziert werden können.

Wie sicher sind die Rechenzentren am Golf? Sie sind extrem verwundbar. Ihre physische Konzentration macht sie zu idealen Zielen für asymmetrische Angriffe durch pro-iranische Milizen.

Wer trägt die juristische Verantwortung für KI-Fehler? Aktuell niemand effektiv. Das geltende Völkerrecht ist auf menschliche Absichten ausgelegt und versagt bei algorithmischer Unvorhersehbarkeit.

Kritik: Die Jagd auf Identitäten

Die Transformation des Krieges durch KI lässt sich in drei Perspektiven demaskieren:

Menschlich

Wir haben den Soldaten durch einen Klick-Arbeiter ersetzt, dessen „menschliche Kontrolle“ nur noch darin besteht, das Unvermeidliche zu bestätigen.

Philosophisch

Wenn der Feind nur noch ein Muster in 400 Millionen Datenobjekten ist, wird ihm die Menschlichkeit entzogen, bevor der erste Schuss fällt. Wir erobern kein Land mehr, wir „bereinigen“ Datenbanken.

Gesellschaftskritisch

Big Tech hat das Pentagon nicht digitalisiert, sondern kolonisiert. Die moralischen Standards eines Staates werden der „Supply Chain“-Logik globaler Konzerne untergeordnet.

Fazit

Der Iran-Konflikt ist der historische Moment, in dem die technologische Diffusion das Völkerrecht endgültig zertrümmert hat. Wir erleben keinen Kampf von Armeen mehr, sondern die systematische Jagd auf Identitäten, gesteuert von Algorithmen und finanziert durch das Kapital des Silicon Valley. Wenn der Krieg zur „Black Box“ wird, in der Verantwortung im Rauschen der Daten verschwindet, haben wir nicht nur die Kontrolle über die Waffen verloren, sondern auch über die Zivilisation. Der nächste Krieg wird nicht mehr erklärt – er wird einfach gepromptet.

Quellen der Inspiration

If Compute is the New Oil, War in the Gulf Significantly Raises the Stakes

Eine Analyse des CSIS, die massive Rechenleistung (Compute) als die neue primäre geopolitische Ressource definiert und die Verwundbarkeit entsprechender Infrastrukturen in der Golfregion aufzeigt.

DoD promised a ’swarm‘ of attack drones. We’re still waiting.

Eine kritische Analyse des „Responsible Statecraft“ über die Kluft zwischen den Versprechungen des US-Verteidigungsministeriums zur Replicator-Initiative und der tatsächlichen operativen Umsetzung.

Economists weigh consequences of war, tariffs, AI

Ein Bericht der Harvard Gazette, in dem Wirtschaftsexperten die weitreichenden globalen und ökonomischen Auswirkungen von künstlicher Intelligenz in Verbindung mit geopolitischen Konflikten diskutieren.

How corporations have collaborated with US military over the decades

Eine historische und aktuelle Untersuchung von Al Jazeera über die Verflechtung und Zusammenarbeit zwischen großen Tech-Konzernen aus dem Silicon Valley und dem US-Militär.

Legal Accountability for AI-Driven Autonomous Weapons

Eine juristische Fachbetrachtung des Lieber Institute (West Point) zu den völkerrechtlichen Herausforderungen und dem „Accountability Gap“ beim Einsatz von KI-gesteuerten autonomen Waffensystemen.

Palantir Technologies Inc | AFSC Investigate

Ein detaillierter Untersuchungsbericht, der die Rolle von Palantir als zentraler Lieferant für militarisierte Datenanalyse-Plattformen und prädiktive KI-Infrastruktur beleuchtet.

The War of the Algorithm

Ein Artikel (veröffentlicht über CEPA/Enrique Dans) über die strategische Transformation der Kriegsführung, bei der Algorithmen zunehmend die menschliche Entscheidungsfindung auf dem Schlachtfeld ersetzen.

The war of the future is already here

Ein sicherheitspolitischer Kommentar über den Paradigmenwechsel von teuren traditionellen Militärplattformen hin zur Dominanz von kostengünstigen, massenhaft produzierten autonomen Systemen.

Drone Swarms: Collective Intelligence in Action

Eine technische Erläuterung der algorithmischen Grundlagen, dezentralen Steuerung und emergenten Eigenschaften von autonomen Drohnenschwärmen.