Der Multi-Agenten-Mythos: Wann ein Agent die überteuerte „Crew“ schlägt

KI-Architekten Guide: Warum Single Agents Multi-Agenten-Systeme schlagen und wie Sie teure Komplexitäts-Fallen bei der LLM-Orchestrierung vermeiden.

Der Status Quo: Die Crew-Inflation

Inhalt entdecken

- 1 Der Status Quo: Die Crew-Inflation

- 2 Die Anatomie des Scheiterns: Wenn Koordination zur Last wird

- 3 Die Renaissance des Single-Agents: Kraft durch Fokus

- 4 Basis-Infos: Agenten-Architektur für Entscheider

- 5 Framework-Check: Wann welche Architektur gewinnt

- 6 Kritik: Drei unbequeme Wahrheiten

- 7 Praxis-Tipps: Den Workflow schlank halten

- 8 FAQ: Zwischen Hype und Handwerk

- 9 Fazit: Jenseits der Multi-Agenten-Euphorie

- 10 Quellen

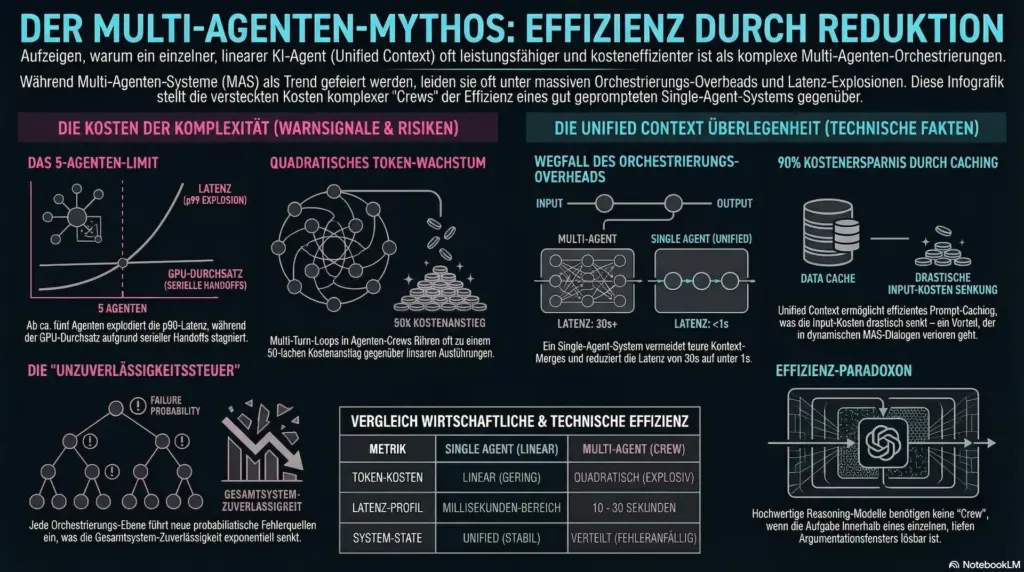

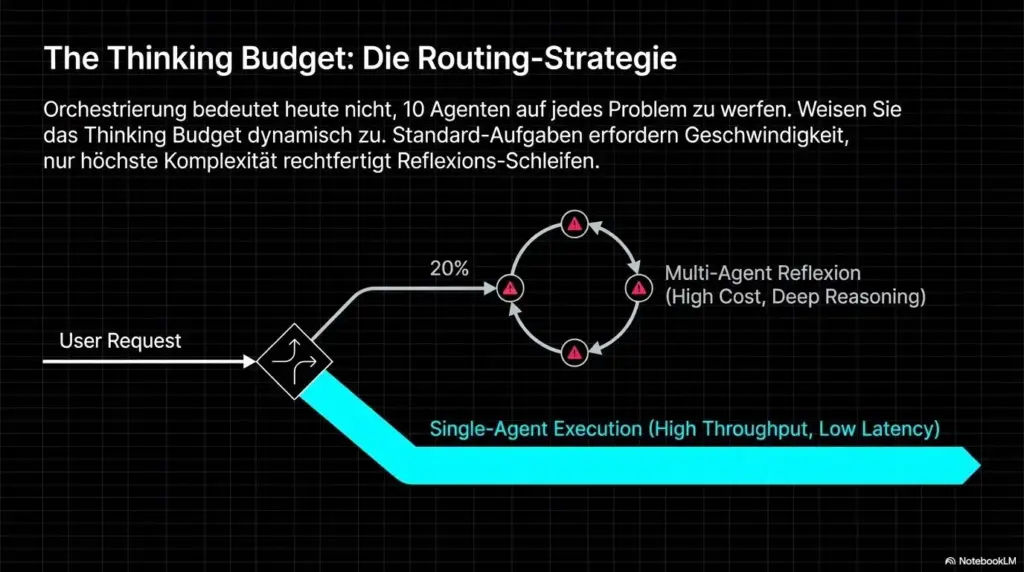

Der aktuelle Multi-Agenten-Hype ist eine technologische Schuldenfalle mit Ansage. Frameworks wie CrewAI und AutoGen suggerieren, dass jede banale Aufgabe eine virtuelle „Abteilung“ erfordert. Gartner prognostiziert zwar, dass bis Ende 2026 etwa 40 % der Enterprise-Anwendungen agentische Komponenten enthalten, doch die Realität in den Serverräumen sieht düster aus. Während Unternehmen blind auf komplexe „Crews“ setzen, stagniert die reale Performance im Treibsand der Koordinations-Latenz. Entwickler betreiben oft „Architecture Theater“ oder „Resume Driven Development“: Sie bauen digitale Bürokratien aus fünf bis zehn Agenten für Probleme, die ein einzelner Agent mit präzisem Context Engineering schneller löst. Diese Inflation der Komplexität maskiert oft nur ein mangelndes Verständnis für robuste Prompt-Strukturen.

Die Anatomie des Scheiterns: Wenn Koordination zur Last wird

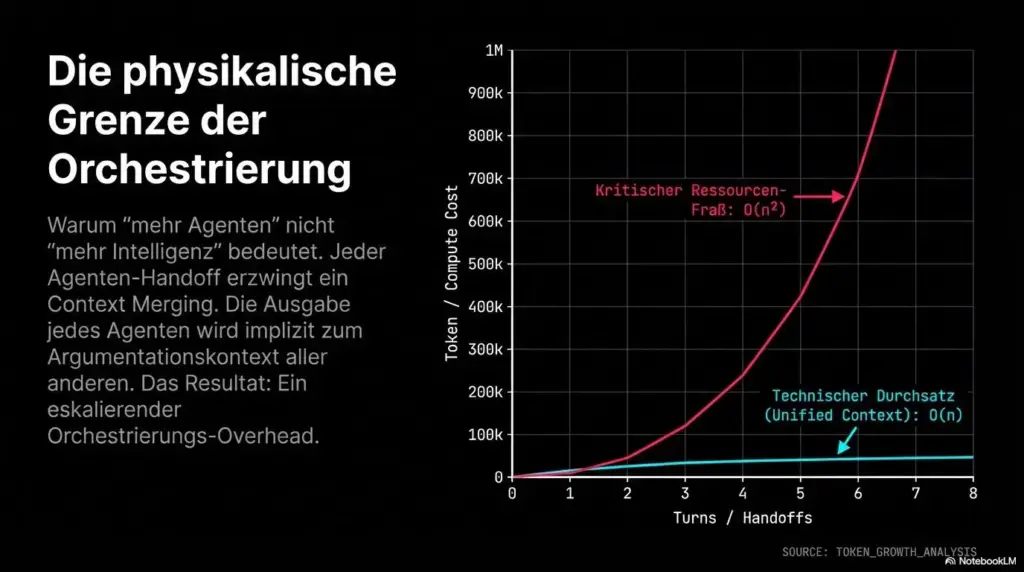

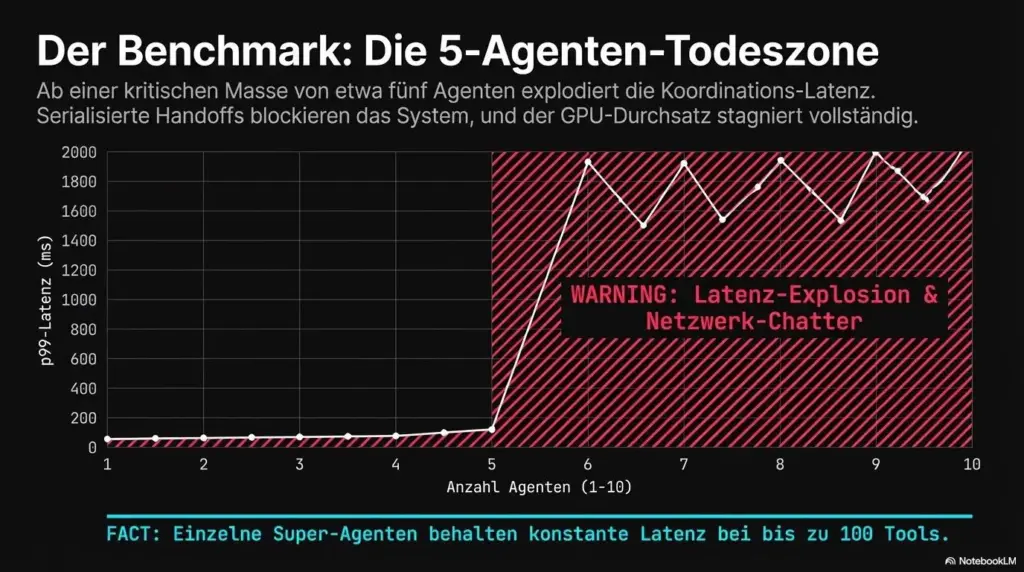

Multi-Agenten-Systeme skalieren nicht linear, sie kollabieren exponentiell unter ihrer eigenen Last. Die technischen Bottlenecks moderner Runtimes machen die Koordination ab einer gewissen Schwelle zur strategischen Haftung.

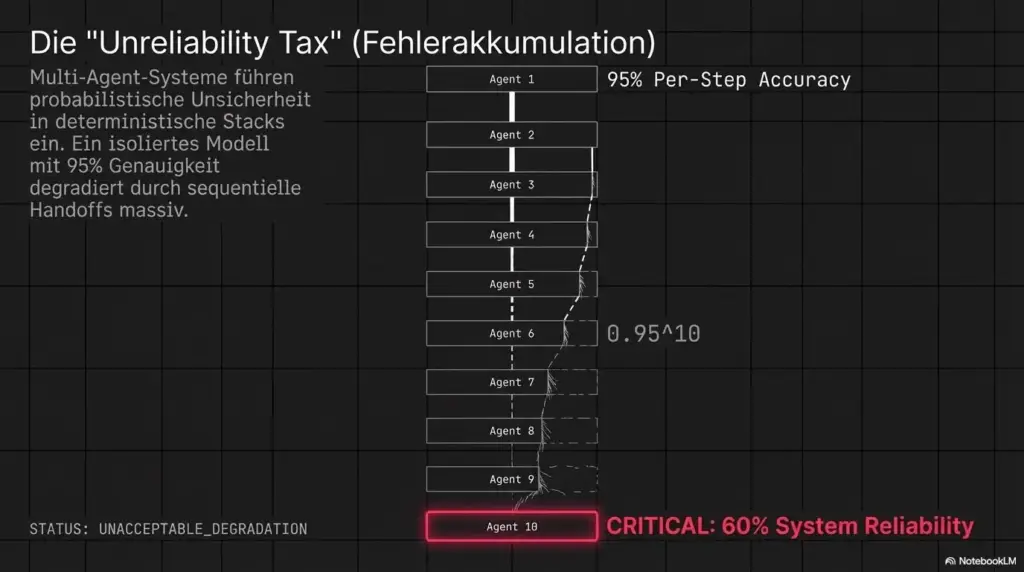

Die Explosion der Latenz und der „Context Rot“

Jeder zusätzliche Agent in einer Kette potenziert das Ausfallrisiko. Ein Modell mit 95 % Genauigkeit pro Schritt liefert bei zehn sequenziellen Schritten nur noch in 60 % der Fälle ein korrektes Ergebnis. Bei 100 Schritten sinkt die Erfolgswahrscheinlichkeit mathematisch gegen Null. Databricks belegt zudem das Phänomen des „Context Rot“: Die Korrektheit der Ergebnisse bricht massiv ein, sobald der Kontext 32.000 Token überschreitet – lange bevor theoretische Limits greifen. Wer Millionen von Traces in Produktion überwacht, benötigt die 80-fache Abfrage-Performance von spezialisierten Tools wie Braintrust, um nicht an der eigenen Observability-Latenz zu ersticken.

Die 5 spezifischen Fehlermodi von Multi-Agenten-Systemen

- Agent Loop Traps: Agenten ohne harte Abbruchbedingungen wiederholen identische Aktionen und verbrennen Token-Budgets ohne Fortschritt.

- Latency Compounding: Antwortzeiten über 3 Sekunden korrelieren direkt mit einer um 21 % höheren Ausfallrate in Multi-Step-Pipelines.

- Selector Brittleness: Starre CSS- oder XPath-Selektoren brechen bei Layout-Änderungen. Ohne spezialisierte APIs wie CapSolver für CAPTCHA-Hürden stoppt jede Kette sofort.

- HTML Overload: Ungefilterter Code erstickt das Reasoning. Während eine Amazon-Produktseite als HTML ca. 896.000 Token schluckt, reduziert Firecrawl diesen Müll auf 8.000 Token Markdown – eine 99 % Reduktion für klares Reasoning.

- Coordination Overhead: Die internen „Debatten“ zwischen Agenten verbrauchen mehr Ressourcen für die Abstimmung als für die eigentliche Lösung.

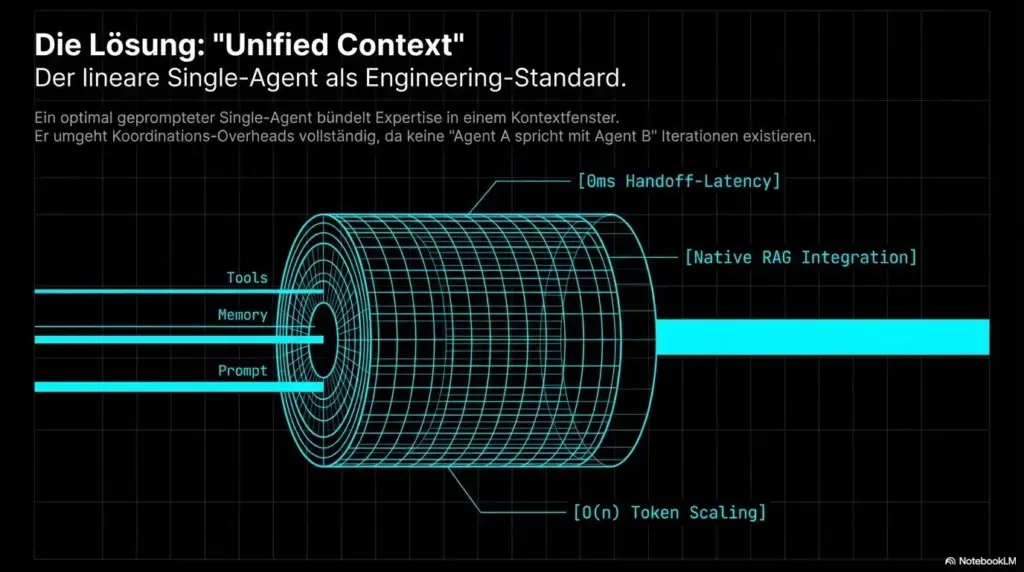

Die Renaissance des Single-Agents: Kraft durch Fokus

Der Single-Agent markiert keinen Rückschritt, sondern die konsequente Umsetzung von Karpathys „Context Engineering“. Anstatt den Fokus auf mehrere Agenten zu fragmentieren, nutzt ein Unified Context den ReAct-Loop (Reason, Act, Observe) hocheffizient.

Effizienz durch den ReAct-Loop

Ein einzelner Agent im ReAct-Modus agiert iterativ: Er denkt, handelt und beobachtet das Ergebnis. Die „Lost in the Middle“-Studie aus Stanford beweist, dass Modelle Informationen am Anfang oder Ende des Inputs am besten verarbeiten. Ein Single-Agent hält diesen Fokus präzise. Durch „Just-in-Time Retrieval“ holt er Informationen erst bei Bedarf ab, was die Entropie des Systems minimiert und die Genauigkeit stabilisiert.

Basis-Infos: Agenten-Architektur für Entscheider

KI-Entscheider müssen die Kernkomponenten verstehen, um den Unterschied zwischen starren Workflows und dynamischen Agenten zu werten:

- Planning: Die Zerlegung eines Ziels in logische Teilschritte.

- Memory: Die Unterscheidung zwischen sensorischem Kurzzeitgedächtnis (Context Window) und Langzeitgedächtnis (Vektordatenbanken).

- Tool Use: Der gezielte Zugriff auf externe APIs oder Web-Scraper.

Ein Workflow folgt vordefinierten Pfaden (Wenn X, dann Y). Ein echter Agent hingegen entscheidet dynamisch basierend auf Beobachtungen, welches Tool er als Nächstes einsetzt. Fehlt diese Entscheidungsfreiheit zur Laufzeit, bleibt das System ein skriptbasierter Chatbot.

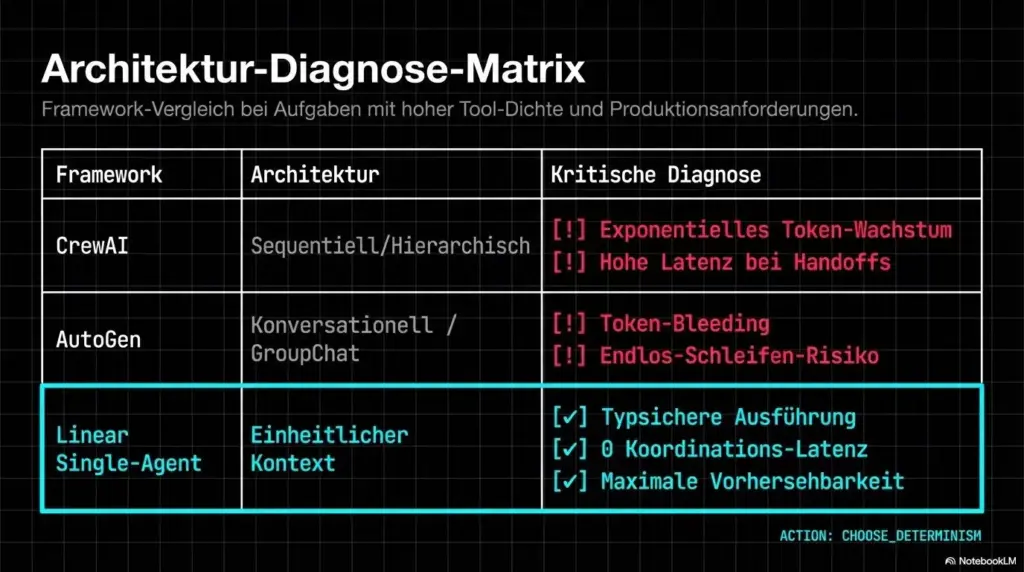

Framework-Check: Wann welche Architektur gewinnt

In der Produktion schlägt Kontrolle fast immer Komfort. Die Wahl des Frameworks zementiert die Fehlertoleranz.

| Framework | Fokus | Ideal für | Größte Schwäche |

| LangGraph | Produktion & Kontrolle | Compliance-kritische Workflows | Hohe Lernkurve, Boilerplate |

| CrewAI | Prototyping | Content-Pipelines, Demos | Fragile Delegationsketten |

| Pydantic AI | Typ-Sicherheit | Validierte strukturierte Outputs | Kosten durch Validierungs-Retries |

| AutoGen | Forschung | Iterative Debatten | Massive Token-Verschwendung |

Kritik: Drei unbequeme Wahrheiten

1. Die Illusion der Autonomie

Benchmarks und Realität klaffen weit auseinander. Im WebArena-Benchmark erreichen GPT-4-Agenten bei realen Web-Aufgaben nur eine Erfolgsquote von 14,4 %. Die meisten „autonomen“ Systeme kollabieren beim ersten Layout-Update einer Zielseite.

2. Komplexität als Selbstzweck

Viele Architekten entwerfen Multi-Agenten-Systeme aus reinem technischem Selbsterhaltungstrieb. Wenn ein einfaches If-Statement das Problem löst, ist der Einsatz einer Agenten-Flotte reine Ressourcenverschwendung.

3. Die Token-Verbrennungs-Maschine

Multi-Agenten-Debatten erzeugen ein Kosten-Nutzen-Paradoxon. Ein einzelner Agent, der sauberes Markdown nutzt, schlägt jede fünfköpfige Crew, die sich durch rohes HTML wühlen muss, in puncto Genauigkeit und Kosten.

Praxis-Tipps: Den Workflow schlank halten

Maximale Performance erfordert harte Regeln für die Entwicklung:

- Markdown-Konvertierung priorisieren: Tools wie Firecrawl wandeln Webseiten in sauberes Markdown um. Das reduziert das Token-Volumen um 99 % und steigert die Retrieval-Genauigkeit laut Tests um 35 %.

- HTML-Ballast abwerfen: Boilerplate-Code im Kontextfenster provoziert Halluzinationen. Ein Agent liefert nur dann Qualität, wenn er ausschließlich relevante Daten sieht.

- Prompt Caching erzwingen: Anthropic ermöglicht bis zu 90 % Kosteneinsparung durch das Caching von System-Prompts.

- Deterministische Pfade bevorzugen: Entwickler sollten Agenten nur für Aufgaben mit echtem Urteilsspielraum nutzen. Den Rest erledigt klassischer, fehlerfreier Code.

FAQ: Zwischen Hype und Handwerk

Warum explodieren meine Crew-Kosten? Jeder Datenaustausch zwischen Agenten schleift die gesamte Historie und Tool-Definitionen als Input-Token mit. Das erzeugt massiven, redundanten Datentransport.

Warum scheitert mein Agent nach wenigen Schritten? Fehler potenzieren sich mathematisch. Eine 95-prozentige Schritt-Genauigkeit führt nach 10 Interaktionen bereits zu einer Fehlerrate von 40 %.

Wie umgehe ich Web-Blocking? Nutzen Sie spezialisierte APIs wie CapSolver oder Firecrawl für den Web-Zugriff. Diese Dienste lösen CAPTCHAs und dynamisches Rendering effizienter als jeder selbstgebaute Headless-Browser.

Wann brauche ich zwingend mehrere Agenten? Multi-Agenten-Systeme glänzen bei Aufgaben mit vollkommen unterschiedlichen Expertisen oder getrennten Berechtigungen. BASF nutzt beispielsweise die „Supervisor Agent Architecture“, um spezialisierte Genie-Agenten für strukturierte Daten mit Vektor-Tools für unstrukturierte Daten zu koordinieren.

Was entscheidet über den Erfolg in der Produktion? Nicht die Intelligenz des Modells, sondern die Qualität des Context Engineering. Ein Agent agiert nur so präzise wie die Daten, die sein Kontextfenster füllen.

Fazit: Jenseits der Multi-Agenten-Euphorie

Einfachheit markiert die höchste Stufe der Eskalation. Während der Markt nach komplexen Architekturen ruft, bleibt der Single-Agent die strategisch kluge Wahl für Zuverlässigkeit und Effizienz. Multi-Agenten-Systeme behalten ihre Berechtigung in der Forschung und bei hochgradig spezialisierten Parallelaufgaben. Für 90 % der Enterprise-Anwendungen stellt eine „Crew“ jedoch lediglich teuren Overhead dar. Wer stabile Systeme bauen will, investiert in sauberen Kontext, robustes Error-Handling und präzises Tool-Design – nicht in zusätzliche Agenten-Rollen.

Quellen

- AI Agents: What They Are, How They Work, and Why Web Context Is the Missing Piece — Analyse zur Bedeutung von Web-Kontext und der Effizienz von Markdown-Konvertierung.

- AI observability tools: A buyer’s guide (2026) — Vergleich von Monitoring-Tools für Agenten-Traces und Performance-Metriken in Produktion.

- LangGraph vs CrewAI vs AutoGen: Which AI Agent Framework Should Your Enterprise Use in 2026? — Strategischer Framework-Vergleich für KI-Entscheider.

- Pydantic AI: Build Type-Safe LLM Agents in Python — Technischer Guide für Agenten mit strikter Typ-Validierung.

- Supervisor Agent Architecture: Orchestrating Enterprise AI at Scale — Fallstudie von BASF zur Orchestrierung spezialisierter Agenten mit Databricks Mosaic AI.

- Top 9 AI Agent Frameworks in 2026 — Übersicht über führende Frameworks und Web-Interaktions-Tools wie CapSolver.