Kinderschutz als Vorwand? Trumps Plan gegen strengere KI-Gesetze der Bundesstaaten

US-Regierung nutzt Kinderschutz, um einzelstaatliche KI-Gesetze auszuhebeln und eine nationale Deregulierung zu erzwingen. Jetzt die Analyse lesen.

Strategische Einordnung: Das moralische Gewand der Deregulierung

Inhalt entdecken

- 1 Strategische Einordnung: Das moralische Gewand der Deregulierung

- 2 Die Mechanik der Macht: Die Erosion einzelstaatlicher Souveränität

- 3 Der Schutzschild: Kindersicherheit als regulatorischer Hebel

- 4 Juristische Frontverläufe: Innovation vs. Grundrechte

- 5 Kritik: Drei Perspektiven auf die nationale Einheitsnorm

- 6 Orientierung im Regelungsdschungel: Was jetzt gilt

- 7 Fazit: Dominanz um jeden Preis?

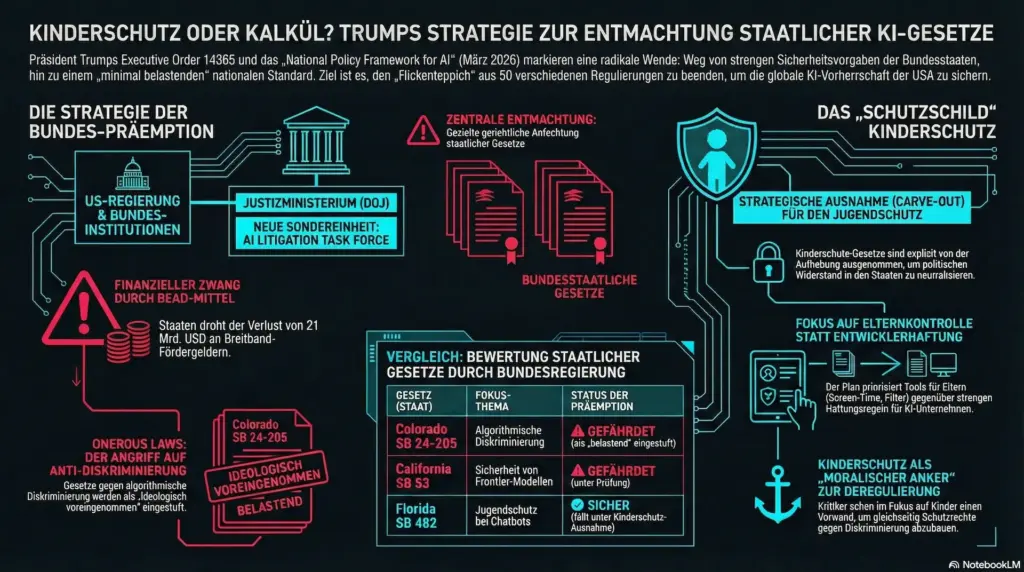

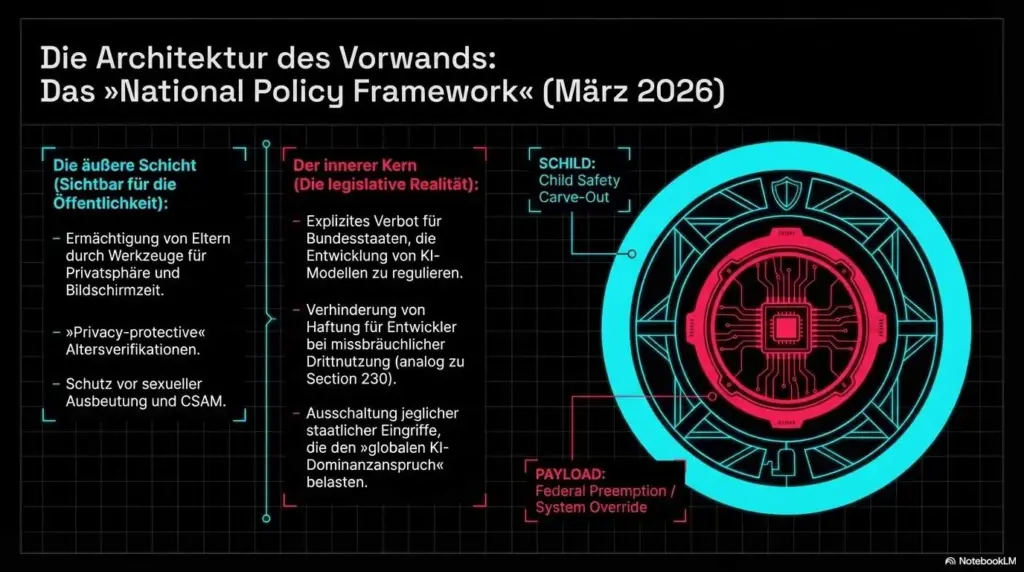

Am 20. März 2026 präsentierte die Trump-Administration das „National Policy Framework for AI“. Dieses Dokument, maßgeblich unter der Regie von David Sacks und Michael Kratsios entstanden, fungiert nicht etwa als altruistischer Schutzbrief, sondern als scharfes Instrument zur nationalen Machtkonzentration. Während die politische Rhetorik – flankiert von Senatorin Marsha Blackburns „TRUMP AMERICA AI Act“ – das Schicksal der Kinder beschwört, verfolgt das Weiße Haus ein weitaus profaneres Ziel: die totale „Preemption“.

Der Bund beansprucht den Vorrang gegenüber einzelstaatlichen Regelungen, um ein innovationsfreundliches, aber regulatorisch karges Umfeld zu erzwingen. Diese teleologische Auslegung des Kinderschutzes dient primär als verfassungsrechtliches Feigenblatt, um den Widerstand der Bundesstaaten gegen eine aggressive Deregulierung zu brechen. Damit verschiebt die Administration den Fokus geschickt von der ethischen Verantwortung der Tech-Giganten hin zu einer rein prozessualen Machtfrage zwischen Washington und den Hauptstädten der Bundesstaaten.

Die Mechanik der Macht: Die Erosion einzelstaatlicher Souveränität

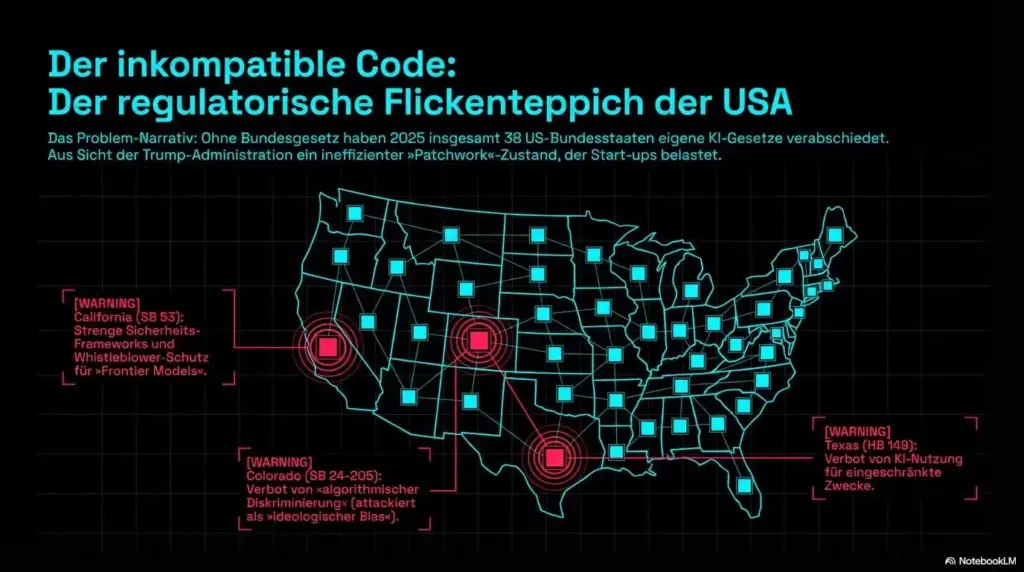

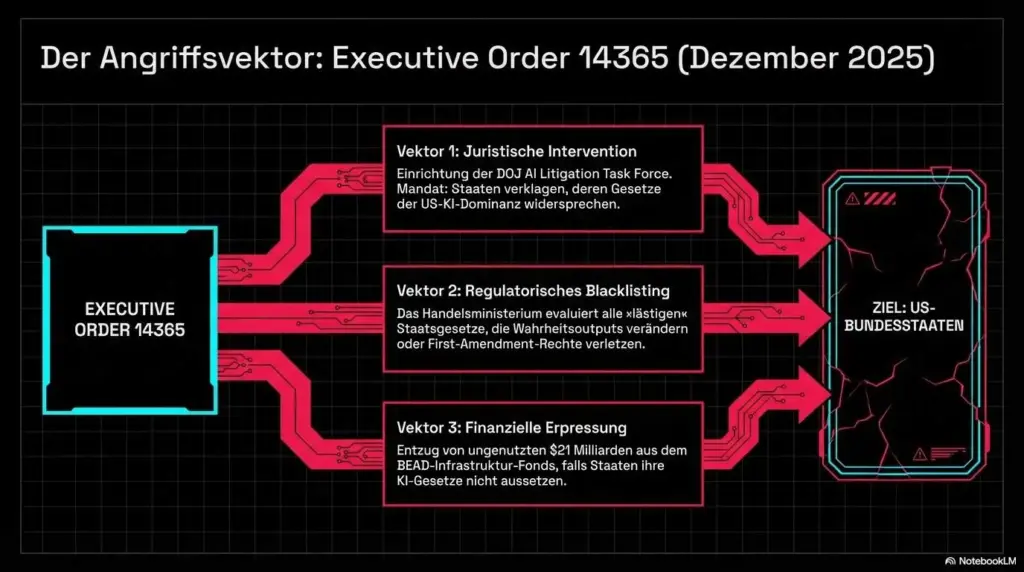

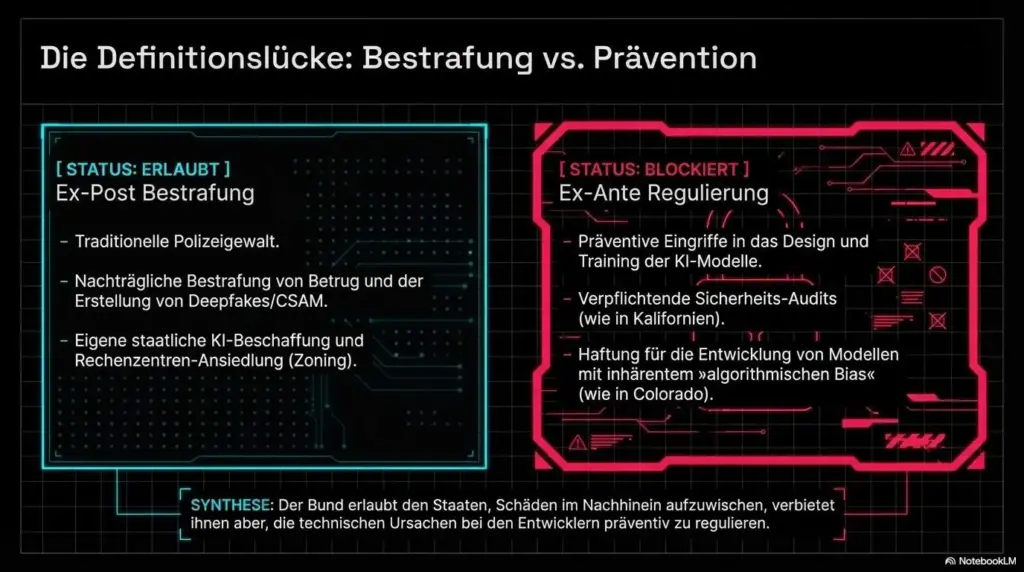

Aus der Perspektive des Weißen Hauses bedroht das „Patchwork“ aus 50 verschiedenen Regulierungssystemen die angestrebte globale KI-Dominanz der USA. Besonders die ex-ante-Regulierung in Colorado und Kalifornien empfindet die Administration als strategisches Hemmnis. Um diese Hürden abzuräumen, setzt die Bundesregierung auf ein Arsenal administrativer Zwangsmaßnahmen:

| Werkzeug der Bundesregierung | Strategische Zielsetzung | Bedrohtes Staatsrecht |

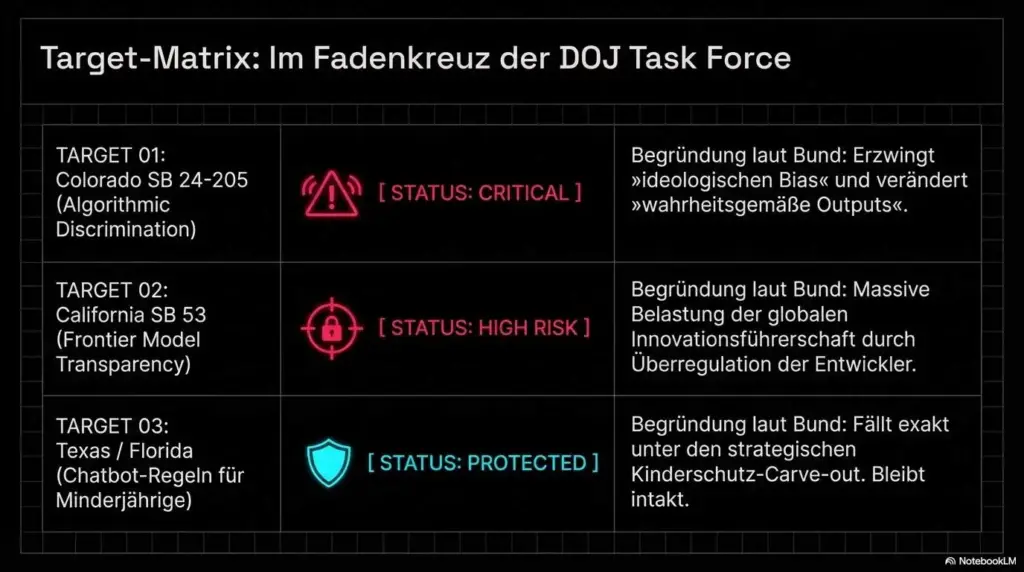

| DOJ AI Litigation Task Force | Systematische Anfechtung „belastender“ Gesetze vor Bundesgerichten. | Police Powers (allgemeine Ordnungs- und Wohlfahrtspflege). |

| FCC-Standards | Schaffung nationaler Meldeformate zur Verdrängung lokaler Transparenzregeln. | Lokale Konsumentenschutz- und Kennzeichnungshoheit. |

| BEAD-Förderbedingungen | Koppelung von ca. 21 Mrd. USD an den Verzicht auf „onerous“ KI-Gesetze. | Staatliche Infrastrukturplanung und Finanzautonomie. |

| FTC Policy Statement | Umdeutung von Bias-Vorgaben als „irreführend“ gemäß Section 5 FTC Act. | Verbraucherschutz gegen algorithmische Diskriminierung. |

Ein Kernstück dieser Strategie bildet die Executive Order 14365. Sie attackiert gezielt den Colorado AI Act (SB 24-205), da dieser laut Administration „ideologische Voreingenommenheit“ erzwingt. Hierbei nutzt die Regierung das Konzept der „impliziten Konflikt-Präemption“: Sobald ein Staatsgesetz die nationalen Ziele der Innovationsführerschaft behindert, erklärt der Bund es für nichtig.

Der Schutzschild: Kindersicherheit als regulatorischer Hebel

Die strategische Finesse des Frameworks offenbart sich in der bewussten Ausnahme des Kinderschutzes von der Präemption. Während der Bund die Kernentwicklung – insbesondere für Modelle über der Schwelle von 10^26 FLOPS – zentralisiert, überlässt er den Staaten das politisch hochsensible Feld der Kindersicherheit. Dies beruhigt die Wählerschaft, während die technologische Basis dereguliert bleibt. Das Framework fordert zwar „parental attestation“ und Altersverifikationen, doch Experten wie Lauro Fava entlarven die technische Naivität dieses Ansatzes. Fava betont die massive Hürde für Plattformen, überhaupt festzustellen, wann eine Beglaubigung nötig ist, da bereits die Identifikation eines Nutzers als Minderjähriger im digitalen Raum oft scheitert.

Das Szenario der juristischen Aushebelung:

- Situation X: Ein Staat erlässt ein Gesetz gegen Bias, um Diskriminierung durch KI-Systeme zu unterbinden.

- Aktion Y: Die FTC interveniert und argumentiert, dass die erzwungene Korrektur von Ergebnissen („alteration of truthful output“) eine Täuschung der Verbraucher nach Section 5 des FTC-Gesetzes darstellt.

- Ergebnis Z: Die Bundesgerichte kassieren das Staatsgesetz als unzulässigen Eingriff in den zwischenstaatlichen Handel und Verstoß gegen den Bundesstandard.

Juristische Frontverläufe: Innovation vs. Grundrechte

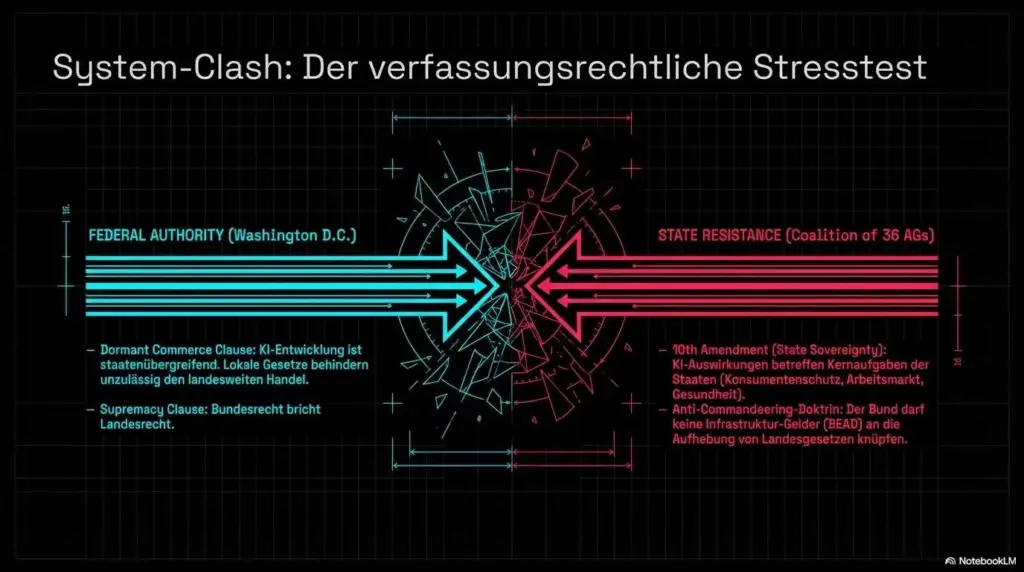

Die Entscheidung über die Zukunft der KI-Regulierung liegt nun bei den Bundesgerichten. Die Administration stützt ihre Argumentation massiv auf die „Dormant Commerce Clause“, die den Staaten untersagt, den überregionalen Handel durch lokale Sonderregeln ungebührlich zu belasten. Die Staaten wiederum verteidigen ihr Recht, Bürger innerhalb ihrer Grenzen vor algorithmischen Gefahren zu schützen.

Warum die Präemption-Strategie scheitern könnte:

- Fehlender Bundesstandard: Executive Orders besitzen ohne explizite Ermächtigung durch den Kongress keine automatische Präemptionskraft gegenüber ordnungsgemäß verabschiedeten Staatsgesetzen.

- Ablehnung durch den Kongress: Der Senat strich bereits mehrfach Versuche einer zehnjährigen KI-Regulierungspause aus Gesetzesentwürfen.

- Major Questions Doctrine: Die Nutzung von Section 5 des FTC-Gesetzes zur großflächigen Aufhebung von Staatsrecht stellt eine beispiellose Machtausweitung ohne klare gesetzliche Basis dar, was die Gerichte nach aktueller Rechtsprechung kaum akzeptieren dürften.

Unterschiede bestehen zudem in der Rechtsnatur: Während die expressive Präemption eine klare gesetzliche Ansage erfordert, versucht die Trump-Administration über die implizite Präemption eine faktische Unvereinbarkeit zu konstruieren, um die Souveränität der Staaten zu unterlaufen.

Kritik: Drei Perspektiven auf die nationale Einheitsnorm

Das Framework bürdet den Eltern eine immense Verantwortung auf. Statt ein sicheres Systemdesign („Safety by Design“) einzufordern, delegiert der Plan den Schutz auf elterliche Kontrolltools. In der Praxis überfordert dies Familien, die mit der technologischen Komplexität von Grenzmodellen allein gelassen werden.

Philosophisch betrachtet offenbart die Strategie eine fragwürdige Priorisierung. Die Freiheit der Innovation mutiert zum absoluten Wert, dem sich der Schutz der Schwächsten unterzuordnen hat. Der Schutzraum der Staaten schrumpft auf eine bloße Resterampe für Themen zusammen, die der globalen Dominanz nicht im Weg stehen.

Gesellschaftlich droht eine Erosion der Antidiskriminierungs-Sicherungssysteme. Unter dem Banner der „ideologischen Neutralität“ brandmarkt die Administration Bias-Prüfungen als Zensur. Wenn die „Wahrhaftigkeit“ der KI-Ausgabe über den Schutz vor Diskriminierung dominiert, dient dies am Ende nur einem Ziel: der totalen Haftungsfreistellung der Entwickler.

Orientierung im Regelungsdschungel: Was jetzt gilt

FAQ für Unternehmen und Entscheidungsträger:

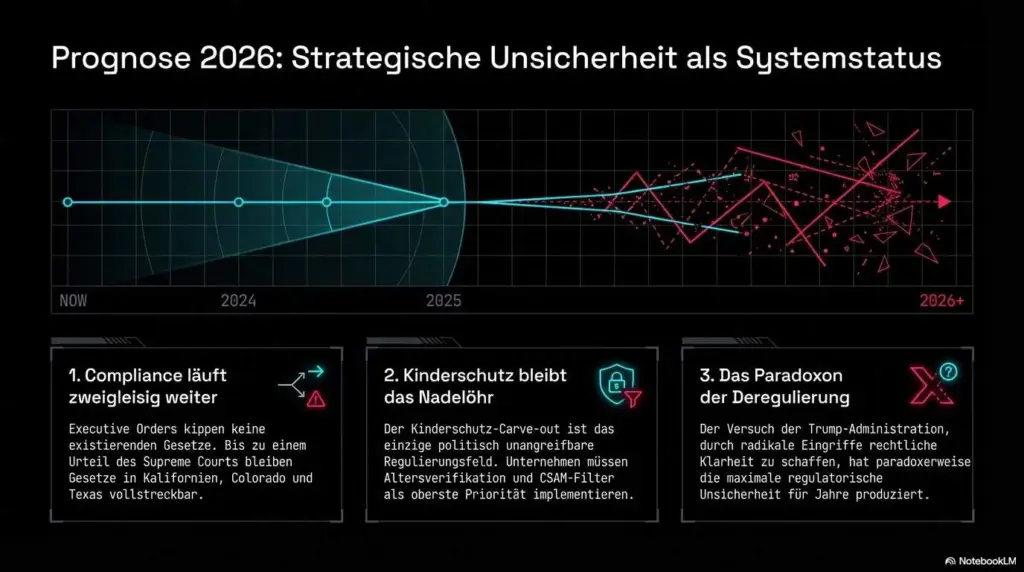

- Muss mein Unternehmen kalifornische Gesetze wie SB 53 weiter beachten? Absolut. Solange kein rechtskräftiges Urteil vorliegt, entfalten einzelstaatliche Gesetze volle Wirkung.

- Was geschieht mit den ca. 21 Milliarden US-Dollar an BEAD-Mitteln? Das Handelsministerium plant, diese Gelder an den Verzicht auf „belastende“ KI-Gesetze zu knüpfen. Staaten müssen hier zwischen Infrastrukturmilliarden und Regulierungshoheit abwägen.

- Ersetzt das Framework den Kongress? Nein. Es handelt sich um eine Empfehlung. Ohne neue Bundesgesetze bleibt die Rechtslage für die „Preemption“ prekär.

- Welche Rolle spielt die „Major Questions Doctrine“? Sie ist das schärfste Schwert der Staaten. Da der Kongress der FTC nie die Macht zur KI-Regulierung übertragen hat, steht die Strategie rechtlich auf tönernen Füßen.

- Sind Deepfakes bereits bundesweit geregelt? Ja, der „TAKE IT DOWN Act“ verpflichtet Plattformen zur Löschung innerhalb von 48 Stunden. Hier herrscht ausnahmsweise Einigkeit.

Praxis-Tipps:

- KI-Inventur durchführen: Erfassen Sie alle Systeme, die Modelle über der 10^26 FLOPS-Grenze nutzen, um spezifische Reporting-Risiken zu bewerten.

- Vendor Agreements anpassen: Überprüfen Sie Haftungsklauseln, insbesondere im Hinblick auf die drohende Einstufung von Bias-Korrekturen als „deceptive practice“ durch die FTC.

- Monitoring der Task Force: Beobachten Sie die DOJ AI Litigation Task Force genau. Die erste Welle an Klagen wird den Takt für nationale Compliance-Strategien vorgeben.

Fazit: Dominanz um jeden Preis?

Das „National Policy Framework for AI“ stellt ein politisches Meisterstück der Rahmung dar. Es nutzt die moralische Unangreifbarkeit des Kinderschutzes, um eine radikale Deregulierung zu legitimieren. Doch die juristische Realität bleibt hinter dem rhetorischen Anspruch zurück.

Solange der Kongress kein einheitliches Gesetz verabschiedet, bleibt der Vorrang des Bundes eine hohle Drohung. Es stellt sich die kritische Frage, ob ein „minimally burdensome“ Standard tatsächlich Kinder schützt – oder ob er lediglich eine haftungsfreie Zone schafft, in der die Sicherheit der Schwächsten der Innovationsgeschwindigkeit geopfert wird. Dieser Standard droht zum „Race to the Bottom“ zu werden, der primär die Entwickler von jeglicher Verantwortung entbindet.

Quellen

- IAPP: Children’s online safety, preemption highlight White House’s AI policy recommendations

- Ropes & Gray: Examining the Landscape and Limitations of the Federal Push to Override State AI Regulation

- JD Supra: March 2026: Federal Deadlines That Will Reshape the AI Regulatory Landscape

- Gibson Dunn: Toward a National AI Policy? The Trump Administration Releases Proposed Framework for Federal Legislation

- Baker Botts: U.S. Artificial Intelligence Law Update: Navigating the Evolving State and Federal Regulatory Landscape

- Pinsent Masons: US child safety measures set out in new AI policy framework

- Baker McKenzie: What the March 20 ‚National AI Legislative Framework‘ Means for US Employers Right Now

- Carnegie Endowment: With the RAISE Act, New York Aligns With California on Frontier AI Laws